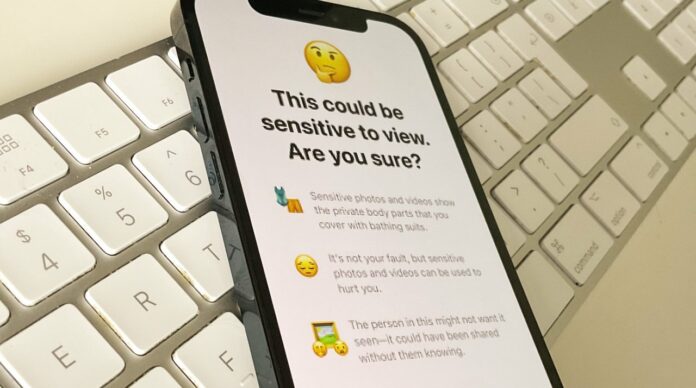

Компанія apple оголосила, що не буде запускати функції для захисту дітей, як планувалося спочатку. Замість цього вона має намір провести консультації, зібрати більше інформації та внести зміни. В електронному листі, надісланому appleinsider та іншим змі, apple повідомила, що прийняла рішення відкласти на невизначений термін функції csam (виявлення фактів сексуального насильства над дітьми) після негативної реакції громадськості.

” минулого місяця ми оголосили про плани впровадити функції, покликані допомогти захистити дітей від переслідувачів, які використовують засоби комунікації для їх залучення та експлуатації, а також обмежити поширення матеріалів з сексуальним насильством над дітьми. Грунтуючись на відгуках клієнтів, правозахисних груп, дослідників та інших осіб, ми вирішили, що нам потрібен додатковий час, щоб зібрати інформацію і внести поліпшення, перш ніж випустити ці критично важливі функції безпеки дітей», — повідомляється в листі apple.

На початку серпня компанія розповіла про функції csam і заявила, що вони з’являться на пристроях apple з виходом нових версій операційних систем для iphone, ipad, macbook і apple watch пізніше цього року. Ці функції включають виявлення зображень сексуального насильства над дітьми в icloud і блокування потенційно небезпечних повідомлень. Експерти в сфері безпеки написали відкритий лист, в якому закликали apple не реалізовувати нові функції, оскільки вони порушують конфіденційність. Компанія детально описала свої наміри і в загальних рисах пояснила, як функції csam повинні працювати, але це нічого не змінило. Зрештою крейг федерігі публічно заявив, що сталася плутанина через одночасне оголошення двох нових функцій.