Для большинства команд дата-инженерии рабочий процесс управления надежностью конвейеров (pipelines) следует разочаровывающему сценарию: задание завершается ошибкой, срабатывает оповещение, и инженерам приходится вручную отслеживать ошибку в распределенных кластерах, чтобы исправить проблему, которая уже нанесла ущерб бизнесу.

Эта «реактивная» модель всё чаще становится узким местом для следующей технологической волны: агентного ИИ (Agentic AI). В отличие от традиционной аналитики, которая может мириться с небольшими задержками или незначительными несоответствиями в данных, системам агентного ИИ для работы требуются высококачественные данные в режиме реального времени. Если конвейер поставляет устаревшие или поврежденные данные, ИИ не просто покажет неверный график — он примет неверные автономные решения.

Чтобы устранить этот разрыв, чикагский стартап Definity меняет парадигму, внедряя интеллект непосредственно в уровень выполнения конвейеров данных.

Архитектура вмешательства: Изнутри против Снаружи

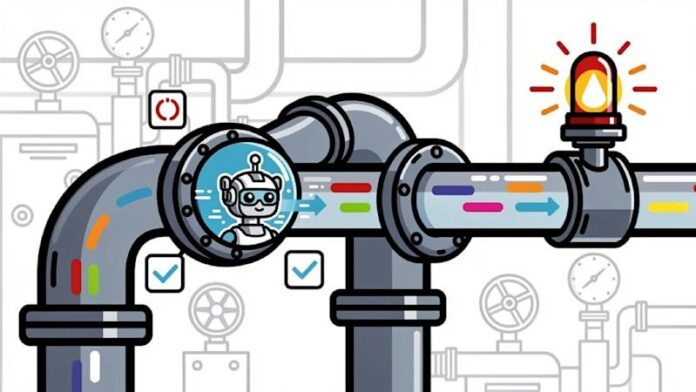

Фундаментальное различие между Definity и существующими лидерами отрасли заключается в том, где происходит мониторинг.

Традиционные инструменты мониторинга — такие как Datadog, Unravel Data или Acceldata — работают «снаружи». Они отслеживают метрики и системные таблицы после того, как задание было завершено. Как объясняет генеральный директор Definity Рой Дэниел, такой подход по своей сути является запоздалым: «К тому моменту, когда вы узнаете, что что-то произошло, это уже произошло». Когда внешний инструмент фиксирует проблему, вычислительные ресурсы уже потрачены впустую, а «плохие» данные уже ушли дальше по цепочке.

Definity использует иной архитектурный подход:

- Встроенная инструментация (Inline Instrumentation): Вместо того чтобы наблюдать издалека, Definity устанавливает JVM-агент непосредственно внутрь драйвера Spark или DBT с помощью одной строки кода.

- Контекст в реальном времени: Поскольку агент находится внутри уровня выполнения, он фиксирует актуальные данные о нагрузке на память, перекосе данных (data skew), паттернах перемешивания (shuffle) и использовании инфраструктуры непосредственно в процессе выполнения задания.

- Активное вмешательство: В отличие от традиционных инструментов, которые только «читают» данные, агенты Definity могут «действовать». Они могут изменять распределение ресурсов прямо во время работы, останавливать задание до того, как оно распространит ошибки, или прерывать конвейер, если обнаружат, что входящие данные устарели.

Реальный эффект: Эффективность важнее эластичности

Ценность этого подхода наиболее заметна в средах с ограниченными ресурсами. Для компаний, использующих локальную (on-premises) инфраструктуру, невозможность мгновенно «масштабироваться в облаке» означает, что каждый неэффективный запрос напрямую конвертируется в неоправданные расходы на оборудование.

Nexxen, рекламная технологическая платформа, является основным примером такой трансформации. Столкнувшись с масштабными нагрузками Spark на собственных мощностях, инженерная команда Nexxen боролась не только с отказами, но и с постоянно растущими затратами из-за неэффективности.

После внедрения Definity результаты были мгновенными:

— Оптимизация: Команда выявила 33% всех возможностей для оптимизации уже в первую неделю.

— Эффективность: Усилия по устранению неполадок и оптимизации сократились на 70%.

— Мощности: Платформа высвободила достаточно ресурсов инфраструктуры, чтобы обеспечить рост нагрузки без необходимости инвестиций в новое оборудование.

Новые вызовы дата-инженерии

Рост Definity сигнализирует о более широком сдвиге в индустрии: эксплуатация конвейеров данных становится проблемой инфраструктуры ИИ.

По мере того как конвейеры данных переходят от поддержки простых дашбордов к обеспечению работы автономных ИИ-агентов, право на ошибку исчезает. Переход от «наблюдения» за сбоем к его «предотвращению» с помощью интеллекта внутри процесса выполнения — это больше не роскошь для оптимизации, а необходимое условие для надежности всего стека ИИ.

Заключение

Внедряя агентов непосредственно в уровень выполнения, Definity переводит работу с данными от реактивной модели «исправь это позже» к проактивной системе реального времени. Этот сдвиг критически важен по мере перехода предприятий к агентному ИИ, где целостность данных является фундаментом для принятия автономных решений.