Pro většinu týmů datového inženýrství následuje pracovní postup řízení spolehlivosti potrubí frustrující scénář: úloha selže, je vydáno upozornění a inženýři musí ručně sledovat chybu napříč distribuovanými clustery, aby opravili problém, který už už ochromuje podnikání.

Tento „reaktivní“ model se stále více stává úzkým hrdlem pro další vlnu technologie: Agentic AI. Na rozdíl od tradiční analýzy, která dokáže tolerovat malá zpoždění nebo drobné nekonzistence v datech, systémy AI založené na agentech vyžadují ke svému provozu vysoce kvalitní data v reálném čase. Pokud kanál dodává zastaralá nebo poškozená data, AI nebude pouze zobrazovat nesprávný graf, ale bude dělat nesprávná autonomní rozhodnutí.

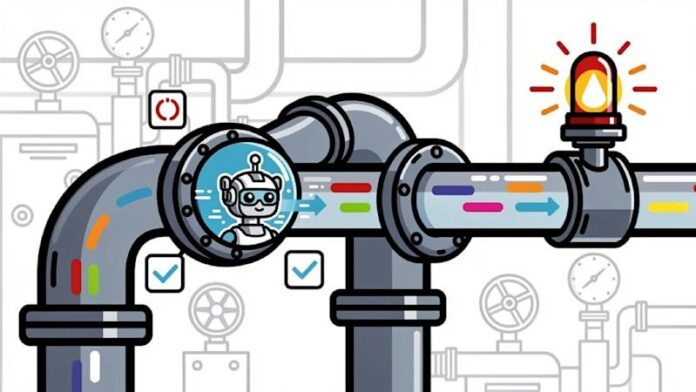

Aby překlenul tuto propast, chicagský startup Definity mění paradigma tím, že vkládá inteligenci přímo do prováděcí vrstvy datových kanálů.

Intervenční architektura: Uvnitř vs

Zásadní rozdíl mezi Definity a stávajícími lídry v oboru spočívá v tom, kde monitorování probíhá.

Tradiční monitorovací nástroje – jako Datadog, Unravel Data nebo Acceldata – fungují „venku dovnitř“. Sledují metriky a systémové tabulky po dokončení úlohy. Jak vysvětluje generální ředitel společnosti Definity Roy Daniel, tento přístup je ve své podstatě dodatečným nápadem: „V době, kdy víte, že se něco stalo, už se to stalo.“ V době, kdy externí nástroj opraví problém, jsou výpočetní zdroje již promarněny a „špatná“ data se již posunula dále v řetězci.

Definity používá jiný architektonický přístup:

- Inline Instrumentation: Místo sledování z dálky nainstaluje Definity agenta JVM přímo do ovladače Spark nebo DBT pomocí jediného řádku kódu.

- Kontext v reálném čase: Vzhledem k tomu, že agent sídlí uvnitř prováděcí vrstvy, zachycuje data v reálném čase o zatížení paměti, zkreslení dat, vzorcích náhodného přehrávání a využití infrastruktury přímo za běhu úlohy.

- Aktivní zásah: Na rozdíl od tradičních nástrojů, které pouze „čtou“ data, mohou agenti Definity „jednat“. Mohou měnit alokace zdrojů za běhu, zastavit úlohu před tím, než rozšíří chyby, nebo přerušit kanál, pokud zjistí, že příchozí data jsou zastaralá.

Skutečný efekt: Účinnost nad elasticitou

Hodnota tohoto přístupu je nejvíce patrná v prostředích s omezenými zdroji. Pro společnosti provozující místní infrastrukturu znamená nemožnost okamžitého „škálování do cloudu“ to, že každý neefektivní požadavek se přímo promítá do zbytečných nákladů na hardware.

Nexxen, platforma reklamních technologií, je ukázkovým příkladem této transformace. Tváří v tvář masivnímu internímu vytížení Sparku se tým inženýrů Nexxen potýkal nejen s poruchami, ale také se stále rostoucími náklady kvůli neefektivitě.

Po implementaci Definity byly výsledky okamžité:

– Optimalizace: Tým identifikoval 33 % všech příležitostí k optimalizaci v prvním týdnu.

– Efektivita: Řešení problémů a optimalizace snížené o 70 %.

– Kapacita: Platforma uvolnila dostatek zdrojů infrastruktury pro podporu růstu zátěže bez nutnosti investovat do nového vybavení.

Nové výzvy v datovém inženýrství

Vzestup společnosti Definity signalizuje širší posun v oboru: Provozování datových kanálů se stává problémem infrastruktury AI.

Jak se datové kanály přesouvají od podpory jednoduchých řídicích panelů k napájení autonomních agentů AI, prostor pro chyby mizí. Přechod od „pozorování“ neúspěchu k jeho „zabránění“ pomocí inteligence v rámci procesu provádění již není luxusem optimalizace, ale nezbytnou podmínkou spolehlivosti celého zásobníku AI.

Závěr

Začleněním agentů přímo do prováděcí vrstvy posouvá Definity správu dat z reaktivního modelu „opravte to později“ na proaktivní systém v reálném čase. Tento posun je kritický, protože podniky přecházejí k AI založené na agentech, kde je integrita dat zásadní pro autonomní rozhodování.