Für die meisten Data-Engineering-Teams folgt der Arbeitsablauf zur Verwaltung der Pipeline-Zuverlässigkeit einem frustrierenden Muster: Ein Job schlägt fehl, eine Warnung wird ausgelöst und Ingenieure müssen den Fehler dann manuell über verteilte Cluster hinweg verfolgen, um ein Problem zu beheben, das sich bereits auf das Unternehmen ausgewirkt hat.

Dieses „reaktive“ Modell wird zunehmend zum Flaschenhals für die nächste Technologiewelle: Agentische KI. Im Gegensatz zu herkömmlichen Analysen, die leichte Verzögerungen oder geringfügige Dateninkonsistenzen tolerieren können, benötigen Agenten-KI-Systeme hochwertige Echtzeitdaten, um zu funktionieren. Wenn eine Pipeline veraltete oder beschädigte Daten liefert, zeigt die KI nicht nur ein falsches Diagramm an, sondern trifft auch falsche autonome Entscheidungen.

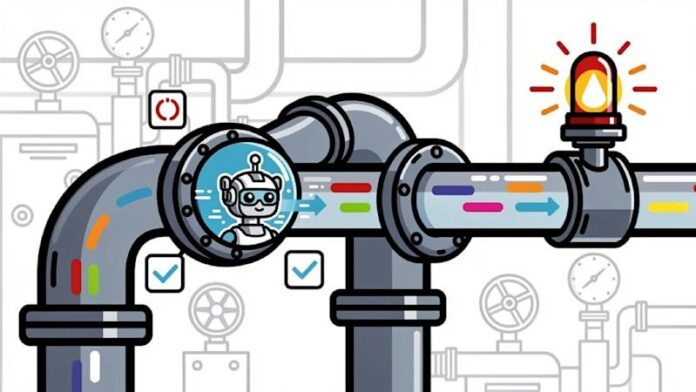

Um diese Lücke zu schließen, führt das in Chicago ansässige Startup Definity einen Paradigmenwechsel durch, indem es Intelligenz direkt in die Ausführungsschicht von Datenpipelines einbettet.

Die Architektur der Intervention: Innen vs. Außen

Der grundlegende Unterschied zwischen Definity und bestehenden Branchenführern liegt darin, wo die Überwachung stattfindet.

Herkömmliche Überwachungstools – wie Datadog, Unravel Data oder Acceldata – arbeiten von außen. Sie beobachten Metriken und Systemtabellen, nachdem ein Auftrag abgeschlossen ist. Wie Roy Daniel, CEO von Definity, erklärt, ist dieser Ansatz von Natur aus spät: „Wenn man weiß, dass etwas passiert ist, ist es bereits passiert.“ Wenn ein externes Tool ein Problem meldet, sind die Rechenressourcen bereits verschwendet und die fehlerhaften Daten sind bereits weitergegeben worden.

Definity verfolgt einen anderen architektonischen Ansatz:

- Inline-Instrumentierung: Anstatt aus der Ferne zuzusehen, installiert Definity über eine einzige Codezeile einen JVM-Agenten direkt im Spark- oder DBT-Treiber.

- Echtzeitkontext: Da sich der Agent innerhalb der Ausführungsschicht befindet, erfasst er während der Auftragsausführung Live-Daten zu Speicherauslastung, Datenversatz, Mischmustern und Infrastrukturauslastung.

- Aktive Intervention: Im Gegensatz zu herkömmlichen Tools, die Daten nur „lesen“, können die Agenten von Definity „handeln“. Sie können die Ressourcenzuteilung während der Ausführung ändern, einen Job stoppen, bevor er Fehler weiterleitet, oder eine Pipeline vorbelegen, wenn sie feststellen, dass Upstream-Daten veraltet sind.

Auswirkungen in der Praxis: Effizienz statt Elastizität

Der Wert dieses Ansatzes zeigt sich am deutlichsten in Umgebungen, in denen die Ressourcen begrenzt sind. Für Unternehmen, die eine On-Premise-Infrastruktur betreiben, bedeutet die Unfähigkeit, in der Cloud sofort „skalieren“ zu können, dass jede ineffiziente Abfrage direkt zu verschwendeten Hardwarekosten führt.

Nexxen, eine Ad-Tech-Plattform, dient als primäre Fallstudie für diesen Übergang. Angesichts der großen On-Premises-Spark-Workloads kämpfte das Technikteam von Nexxen nicht nur mit Ausfällen, sondern auch mit den steigenden Kosten der Ineffizienz.

Nach der Bereitstellung von Definity waren die Ergebnisse sofort sichtbar:

– Optimierung: Das Team identifizierte 33 % aller Optimierungsmöglichkeiten innerhalb der ersten Woche.

– Effizienz: Der Aufwand zur Fehlerbehebung und Optimierung wurde um 70 % reduziert.

– Kapazität: Die Plattform hat genügend Infrastrukturkapazität freigeschaltet, um ein Arbeitslastwachstum zu ermöglichen, ohne dass neue Hardwareinvestitionen erforderlich sind.

Die neuen Herausforderungen des Data Engineering

Der Aufstieg von Definity signalisiert einen umfassenderen Wandel in der Branche: Der Betrieb von Datenpipelines wird zu einem Problem der KI-Infrastruktur.

Da sich Datenpipelines von der Unterstützung einfacher Dashboards hin zur Unterstützung autonomer KI-Agenten entwickeln, ist die Fehlerquote geschwunden. Der Übergang von der „Beobachtung“ eines Fehlers zur „Verhinderung“ durch In-Execution-Intelligence ist nicht mehr nur ein Luxus für die Optimierung – er wird zu einer Voraussetzung für die Zuverlässigkeit des gesamten KI-Stacks.

Schlussfolgerung

Durch die direkte Einbettung von Agenten in die Ausführungsebene verschiebt Definity Datenoperationen von einem reaktiven „Fix-it-später“-Modell zu einem proaktiven Echtzeitsystem. Dieser Wandel ist von entscheidender Bedeutung, da Unternehmen auf die Agenten-KI umsteigen, bei der die Datenintegrität die Grundlage für autonome Entscheidungsfindung ist.