W przypadku większości zespołów zajmujących się inżynierią danych przepływ pracy związany z zarządzaniem niezawodnością potoków przebiega według frustrującego scenariusza: zadanie kończy się niepowodzeniem, pojawia się alert, a inżynierowie muszą ręcznie śledzić błąd w rozproszonych klastrach, aby naprawić problem, który już paraliżuje działalność firmy.

Ten „reaktywny” model w coraz większym stopniu staje się wąskim gardłem dla kolejnej fali technologii: Agentycznej sztucznej inteligencji. W przeciwieństwie do tradycyjnych metod analitycznych, które tolerują niewielkie opóźnienia lub drobne niespójności w danych, systemy sztucznej inteligencji oparte na agentach wymagają do działania wysokiej jakości danych dostarczanych w czasie rzeczywistym. Jeśli potok dostarcza nieaktualne lub uszkodzone dane, sztuczna inteligencja nie tylko pokaże zły wykres, ale podejmie błędne autonomiczne decyzje.

Aby wypełnić tę lukę, chicagowski startup Definity zmienia paradygmat, osadzając inteligencję bezpośrednio w warstwie wykonawczej potoków danych.

Architektura interwencyjna: wnętrze kontra zewnętrze

Podstawowa różnica pomiędzy Definity a obecnymi liderami branży polega na miejscu monitorowania.

Tradycyjne narzędzia monitorujące – takie jak Datadog, Unravel Data czy Acceldata – działają „od zewnątrz do wewnątrz”. Śledzą metryki i tabele systemowe po ukończeniu zadania. Jak wyjaśnia dyrektor generalny Definity, Roy Daniel, takie podejście wynika z refleksji: „Zanim zorientujesz się, że coś się wydarzyło, już to nastąpiło”. Zanim zewnętrzne narzędzie rozwiąże problem, zasoby obliczeniowe zostaną już zmarnowane, a „złe” dane zostaną już przesunięte w dół łańcucha.

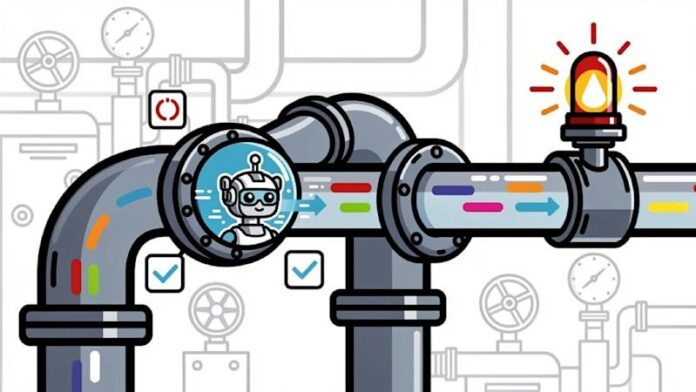

Definity przyjmuje inne podejście architektoniczne:

- Oprzyrządowanie wbudowane: Zamiast patrzeć z daleka, Definity instaluje agenta JVM bezpośrednio w sterowniku Spark lub DBT za pomocą jednej linii kodu.

- Kontekst czasu rzeczywistego: Ponieważ agent znajduje się w warstwie wykonawczej, przechwytuje w czasie rzeczywistym dane dotyczące obciążenia pamięci, zniekształceń danych, wzorców tasowania i wykorzystania infrastruktury bezpośrednio podczas wykonywania zadania.

- Aktywna interwencja: W przeciwieństwie do tradycyjnych narzędzi, które jedynie „odczytują” dane, agenci Definity mogą „działać”. Mogą zmieniać przydział zasobów w trakcie działania, zatrzymywać zadanie, zanim spowoduje propagację błędów, lub przerywać potok, jeśli wykryje, że przychodzące dane są nieaktualne.

Rzeczywisty efekt: wydajność ponad elastyczność

Wartość tego podejścia jest najbardziej zauważalna w środowiskach o ograniczonych zasobach. Dla firm posiadających infrastrukturę on-premise brak możliwości błyskawicznego „skalowania do chmury” oznacza, że każde nieskuteczne żądanie bezpośrednio przekłada się na niepotrzebne koszty sprzętu.

Nexxen, platforma technologii reklamowych, jest doskonałym przykładem tej transformacji. W obliczu ogromnego obciążenia pracą Sparka zespół inżynierów Nexxen zmagał się nie tylko z awariami, ale także ze stale rosnącymi kosztami wynikającymi z nieefektywności.

Po wdrożeniu Definity rezultaty były natychmiastowe:

– Optymalizacja: zespół zidentyfikował 33% wszystkich możliwości optymalizacji w pierwszym tygodniu.

– Wydajność: Wysiłki związane z rozwiązywaniem problemów i optymalizacją zmniejszone o 70%.

– Wydajność: platforma uwolniła wystarczające zasoby infrastruktury, aby obsłużyć wzrost obciążenia bez konieczności inwestowania w nowy sprzęt.

Nowe wyzwania w inżynierii danych

Rozwój Definity sygnalizuje szerszą zmianę w branży: Obsługa potoków danych staje się problemem infrastruktury sztucznej inteligencji.

W miarę jak potoki danych przestają wspierać proste pulpity nawigacyjne na rzecz autonomicznych agentów AI, margines błędu znika. Przejście od „obserwowania” awarii do „zapobiegania” jej wykorzystaniu inteligencji w procesie wykonawczym nie jest już luksusem optymalizacji, ale warunkiem koniecznym niezawodności całego stosu AI.

Wniosek

Osadzając agentów bezpośrednio w warstwie wykonawczej, Definity przenosi zarządzanie danymi z reaktywnego modelu „napraw to później” do proaktywnego systemu czasu rzeczywistego. Ta zmiana ma kluczowe znaczenie, ponieważ przedsiębiorstwa przechodzą na sztuczną inteligencję opartą na agentach, gdzie integralność danych ma fundamentalne znaczenie dla autonomicznego podejmowania decyzji.