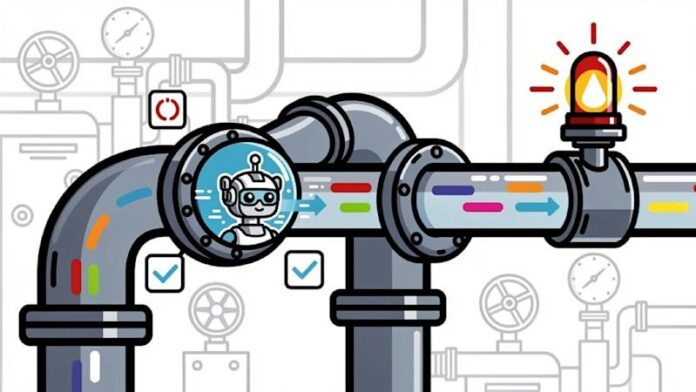

Per la maggior parte dei team di ingegneria dei dati, il flusso di lavoro per la gestione dell’affidabilità della pipeline segue uno schema frustrante: un lavoro fallisce, si attiva un avviso e gli ingegneri devono quindi tracciare manualmente l’errore tra i cluster distribuiti per risolvere un problema che ha già avuto un impatto sull’azienda.

Questo modello “reattivo” sta diventando sempre più un collo di bottiglia per la prossima ondata tecnologica: l’Agentic AI. A differenza dell’analisi tradizionale, che può tollerare lievi ritardi o piccole incoerenze dei dati, i sistemi di intelligenza artificiale ad agenti richiedono dati in tempo reale e di alta qualità per funzionare. Se una pipeline fornisce dati obsoleti o danneggiati, l’intelligenza artificiale non si limita a mostrare un grafico sbagliato, ma prende decisioni autonome errate.

Per colmare questa lacuna, la startup Definity con sede a Chicago sta cambiando il paradigma incorporando l’intelligenza direttamente nel livello di esecuzione delle pipeline di dati.

L’architettura dell’intervento: interno vs esterno

La differenza fondamentale tra Definity e i leader del settore esistenti risiede nel dove avviene il monitoraggio.

Gli strumenti di monitoraggio tradizionali, come Datadog, Unravel Data o Acceldata, operano dall’esterno. Osservano le metriche e le tabelle di sistema dopo che un lavoro è stato completato. Come spiega Roy Daniel, CEO di Definity, questo approccio è intrinsecamente tardivo: “Quando sai che qualcosa è successo, è già successo”. Nel momento in cui uno strumento esterno segnala un problema, le risorse di calcolo sono già state sprecate e i dati errati sono già passati a valle.

Definity adotta un approccio architettonico diverso:

- Strumentazione in linea: Invece di guardare da lontano, Definity installa un agente JVM direttamente all’interno del driver Spark o DBT tramite un’unica riga di codice.

- Contesto in tempo reale: poiché l’agente si trova all’interno del livello di esecuzione, acquisisce dati in tempo reale su utilizzo della memoria, distorsione dei dati, modelli di riproduzione casuale e utilizzo dell’infrastruttura durante l’esecuzione del processo.

- Intervento attivo: a differenza degli strumenti tradizionali che si limitano a “leggere” i dati, gli agenti di Definity possono “agire”. Possono modificare l’allocazione delle risorse durante l’esecuzione, interrompere un processo prima che propaghi errori o anticipare una pipeline se rilevano che i dati upstream sono obsoleti.

Impatto nel mondo reale: efficienza rispetto all’elasticità

Il valore di questo approccio è più visibile negli ambienti in cui le risorse sono limitate. Per le aziende che gestiscono infrastrutture on-premise, l’incapacità di “scalare” istantaneamente nel cloud significa che ogni query inefficiente si traduce direttamente in costi hardware sprecati.

Nexxen, una piattaforma di tecnologia pubblicitaria, funge da case study principale per questa transizione. Di fronte a carichi di lavoro Spark su larga scala in locale, il team di ingegneri di Nexxen ha dovuto affrontare non solo i guasti, ma anche i costi crescenti dell’inefficienza.

Dopo aver distribuito Definity, i risultati sono stati immediati:

– Ottimizzazione: il team ha identificato il 33% di tutte le opportunità di ottimizzazione entro la prima settimana.

– Efficienza: gli sforzi di risoluzione dei problemi e di ottimizzazione sono stati ridotti del 70%.

– Capacità: la piattaforma ha sbloccato una capacità infrastrutturale sufficiente per consentire la crescita del carico di lavoro senza la necessità di nuovi investimenti hardware.

La nuova posta in gioco dell’ingegneria dei dati

L’ascesa di Definity segnala un cambiamento più ampio nel settore: Le operazioni di pipeline di dati stanno diventando un problema di infrastruttura AI.

Man mano che le pipeline di dati passano dal supportare semplici dashboard all’alimentare agenti di intelligenza artificiale autonomi, il margine di errore è svanito. Il passaggio dall'”osservazione” di un fallimento al “prevenimento” attraverso l’intelligenza in esecuzione non è più solo un lusso per l’ottimizzazione: sta diventando un requisito per l’affidabilità dell’intero stack di intelligenza artificiale.

Conclusione

Incorporando gli agenti direttamente nel livello di esecuzione, Definity sta spostando le operazioni sui dati da un modello reattivo “aggiustalo in seguito” a un sistema proattivo in tempo reale. Questo cambiamento è fondamentale poiché le aziende si spostano verso l’intelligenza artificiale, dove l’integrità dei dati è il fondamento del processo decisionale autonomo.