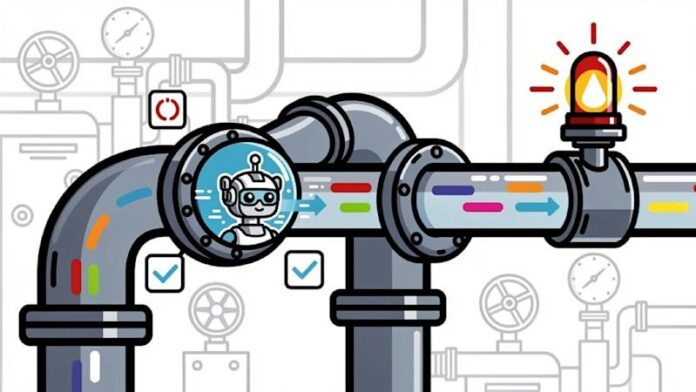

Para a maioria das equipes de engenharia de dados, o fluxo de trabalho para gerenciar a confiabilidade do pipeline segue um padrão frustrante: um trabalho falha, um alerta é acionado e os engenheiros devem rastrear manualmente o erro em clusters distribuídos para corrigir um problema que já afetou os negócios.

Esse modelo “reativo” está se tornando cada vez mais um gargalo para a próxima onda de tecnologia: Agentic AI. Ao contrário da análise tradicional, que pode tolerar pequenos atrasos ou pequenas inconsistências de dados, os sistemas de IA de agência requerem dados de alta qualidade e em tempo real para funcionar. Se um pipeline entregar dados obsoletos ou corrompidos, a IA não apenas mostra um gráfico errado – ela toma decisões autônomas incorretas.

Para preencher essa lacuna, a startup Definity, com sede em Chicago, está mudando o paradigma ao incorporar inteligência diretamente na camada de execução dos pipelines de dados.

A Arquitetura de Intervenção: Dentro vs.

A diferença fundamental entre o Definity e os líderes existentes do setor está em onde o monitoramento acontece.

Ferramentas de monitoramento tradicionais – como Datadog, Unravel Data ou Acceldata – operam externamente. Eles observam métricas e tabelas de sistema após a conclusão de um trabalho. Como explica Roy Daniel, CEO da Definity, essa abordagem é inerentemente tardia: “Quando você sabe que algo aconteceu, já aconteceu”. No momento em que uma ferramenta externa sinaliza um problema, os recursos de computação já foram desperdiçados e os dados incorretos já fluíram downstream.

Definity adota uma abordagem arquitetônica diferente:

- Instrumentação Inline: Em vez de observar de longe, o Definity instala um agente JVM diretamente dentro do driver Spark ou DBT por meio de uma única linha de código.

- Contexto em tempo real: Como o agente fica dentro da camada de execução, ele captura dados em tempo real sobre pressão de memória, distorção de dados, padrões de embaralhamento e utilização da infraestrutura à medida que o trabalho é executado.

- Intervenção ativa: Ao contrário das ferramentas tradicionais que apenas “lêem” dados, os agentes da Definity podem “agir”. Eles podem modificar a alocação de recursos no meio da execução, interromper um trabalho antes que ele propague erros ou interromper um pipeline se detectarem que os dados upstream estão obsoletos.

Impacto no mundo real: eficiência acima da elasticidade

O valor desta abordagem é mais visível em ambientes onde os recursos são finitos. Para empresas que executam infraestrutura local, a incapacidade de “aumentar a escala” instantaneamente na nuvem significa que cada consulta ineficiente se traduz diretamente em desperdício de custos de hardware.

Nexxen, uma plataforma de tecnologia de anúncios, serve como estudo de caso principal para essa transição. Enfrentando cargas de trabalho locais em larga escala do Spark, a equipe de engenharia da Nexxen lutou não apenas com falhas, mas também com o custo crescente da ineficiência.

Após a implantação do Definity, os resultados foram imediatos:

– Otimização: a equipe identificou 33% de todas as oportunidades de otimização na primeira semana.

– Eficiência: Os esforços de solução de problemas e otimização foram reduzidos em 70%.

– Capacidade: a plataforma liberou capacidade de infraestrutura suficiente para permitir o crescimento da carga de trabalho sem a necessidade de novos investimentos em hardware.

As novas apostas da engenharia de dados

A ascensão do Definity sinaliza uma mudança mais ampla na indústria: As operações de pipeline de dados estão se tornando um problema de infraestrutura de IA.

À medida que os pipelines de dados passam do suporte a painéis simples para a alimentação de agentes autônomos de IA, a margem de erro desapareceu. A transição de “observar” uma falha para “preveni-la” por meio de inteligência durante a execução não é mais apenas um luxo para otimização – está se tornando um requisito para a confiabilidade de toda a pilha de IA.

Conclusão

Ao incorporar agentes diretamente na camada de execução, o Definity está migrando as operações de dados de um modelo reativo de “consertar depois” para um sistema proativo em tempo real. Esta mudança é crítica à medida que as empresas avançam para a IA agente, onde a integridade dos dados é a base da tomada de decisões autónoma.