Для більшості команд дата-інженерії робочий процес управління надійністю конвеєрів (pipelines) слід розчаровує сценарію: завдання завершується помилкою, спрацьовує оповіщення, і інженерам доводиться вручну відстежувати помилку в розподілених кластерах, щоб виправити проблему, яка вже завдала шкоди бізнесу.

Ця «реактивна» модель все частіше стає вузьким місцем для наступної технологічної хвилі: агентного ІІ (Agentic AI). На відміну від традиційної аналітики, яка може миритися з невеликими затримками або незначними невідповідностями даних, системам агентного ІІ для роботи потрібні високоякісні дані в режимі реального часу. Якщо конвеєр постачає застарілі чи пошкоджені дані, ІІ не просто покаже невірний графік — він ухвалить невірні автономні рішення.

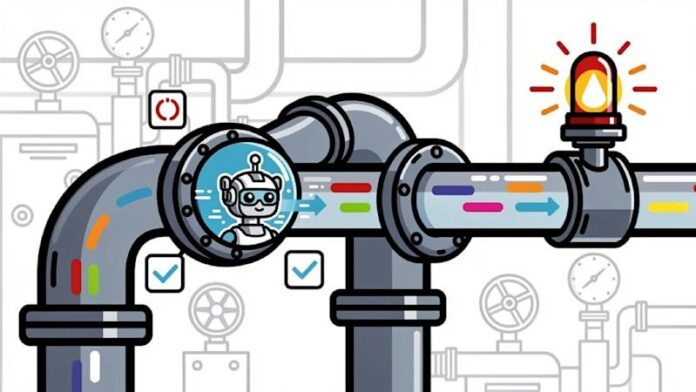

Щоб усунути цей розрив, стартап Чикаго Definity змінює парадигму, впроваджуючи інтелект безпосередньо в рівень виконання конвеєрів даних.

Архітектура втручання: Зсередини проти Зовні

Фундаментальна різниця між Definity та існуючими лідерами галузі полягає в тому, де відбувається моніторинг.

Традиційні інструменти моніторингу, такі як Datadog, Unravel Data або Acceldata, працюють «зовні». Вони відстежують метрики та системні таблиці після того, як завдання було завершено. Як пояснює генеральний директор Definity Рой Деніел, такий підхід за своєю суттю є запізнілим: “До того моменту, коли ви дізнаєтеся, що щось сталося, це вже сталося”. Коли зовнішній інструмент фіксує проблему, обчислювальні ресурси вже витрачені даремно, а погані дані вже пішли далі ланцюжком.

Definity використовує інший архітектурний підхід:

- Вбудована інструментація (Inline Instrumentation): Замість того, щоб спостерігати здалеку, Definity встановлює JVM-агент безпосередньо всередину драйвера Spark або DBT за допомогою одного рядка коду.

- Контекст у реальному часі: Оскільки агент знаходиться всередині рівня виконання, він фіксує актуальні дані про навантаження на пам’ять, перекос даних (data skew), патерни перемішування (shuffle) та використання інфраструктури безпосередньо в процесі виконання завдання.

- Активне втручання: На відміну від традиційних інструментів, які тільки читають дані, агенти Definity можуть діяти. Вони можуть змінювати розподіл ресурсів прямо під час роботи, зупиняти завдання до того, як воно поширить помилки, або переривати конвеєр, якщо виявлять, що вхідні дані застаріли.

Реальний ефект: Ефективність важливіша за еластичність

Цінність цього підходу найбільш помітна серед з обмеженими ресурсами. Для компаній, що використовують локальну (on-premises) інфраструктуру, неможливість миттєво «масштабуватися у хмарі» означає, що кожен неефективний запит безпосередньо конвертується у невиправдані витрати на обладнання.

Nexxen, рекламна технологічна платформа, є основним прикладом такої трансформації. Зіткнувшись з масштабними навантаженнями Spark на власних потужностях, інженерна команда Nexxen боролася не тільки з відмовами, але і з витратами, що постійно зростають, через неефективність.

Після впровадження Definity результати були миттєвими:

– Оптимізація: Команда виявила 33% усіх можливостей для оптимізації вже першого тижня.

– Ефективність: Зусилля щодо усунення несправностей та оптимізації скоротилися на 70%.

– Потужності: Платформа вивільнила достатньо ресурсів інфраструктури, щоб забезпечити зростання навантаження без необхідності інвестицій у нове обладнання.

Нові виклики дата-інженерії

Зростання Definity сигналізує про ширше зрушення в індустрії: експлуатація конвеєрів даних стає проблемою інфраструктури ІІ.

У міру того, як конвеєри даних переходять від підтримки простих дашбордів до забезпечення роботи автономних ІІ-агентів, право на помилку зникає. Перехід від «спостереження» за збоєм до його «запобігання» за допомогою інтелекту всередині процесу виконання — це не розкіш для оптимізації, а необхідна умова для надійності всього стека ІІ.

Висновок

Впроваджуючи агентів у рівень виконання, Definity переводить роботу з даними від реактивної моделі «виправ це пізніше» до проактивної системі реального часу. Цей зсув критично важливий у міру переходу підприємств до агентного ІІ, де цілісність даних є фундаментом прийняття автономних рішень.