Pour la plupart des équipes d’ingénierie de données, le flux de travail de gestion de la fiabilité des pipelines suit un schéma frustrant : une tâche échoue, une alerte se déclenche et les ingénieurs doivent ensuite tracer manuellement l’erreur sur les clusters distribués pour résoudre un problème qui a déjà affecté l’entreprise.

Ce modèle « réactif » devient de plus en plus un goulot d’étranglement pour la prochaine vague technologique : l’Agentic AI. Contrairement aux analyses traditionnelles, qui peuvent tolérer de légers retards ou des incohérences mineures des données, les systèmes d’IA agentique nécessitent des données en temps réel de haute qualité pour fonctionner. Si un pipeline fournit des données obsolètes ou corrompues, l’IA ne se contente pas d’afficher un mauvais graphique : elle prend des décisions autonomes incorrectes.

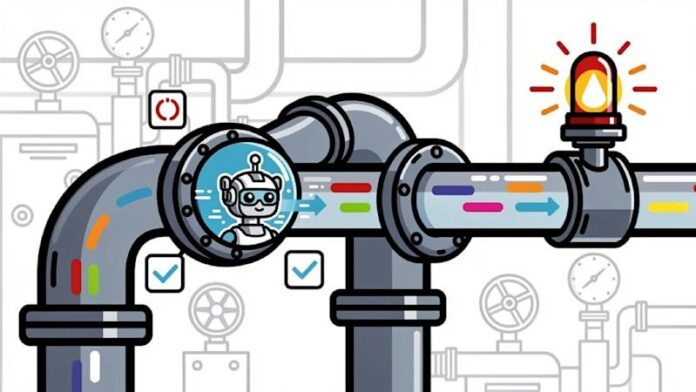

Pour combler cette lacune, la startup Definity, basée à Chicago, change de paradigme en intégrant l’intelligence directement dans la couche d’exécution des pipelines de données.

L’architecture de l’intervention : intérieur ou extérieur

La différence fondamentale entre Definity et les leaders existants de l’industrie réside dans où la surveillance a lieu.

Les outils de surveillance traditionnels, tels que Datadog, Unravel Data ou Acceldata, fonctionnent de l’extérieur. Ils observent les métriques et les tables système après la fin d’un travail. Comme l’explique Roy Daniel, PDG de Definity, cette approche est par nature tardive : « Au moment où vous savez que quelque chose s’est produit, c’est déjà arrivé. » Au moment où un outil externe signale un problème, les ressources de calcul ont déjà été gaspillées et les mauvaises données ont déjà afflué en aval.

Definity adopte une approche architecturale différente :

- Instrumentation en ligne : Au lieu de regarder de loin, Definity installe un agent JVM directement dans le pilote Spark ou DBT via une seule ligne de code.

- Contexte en temps réel : Étant donné que l’agent se trouve à l’intérieur de la couche d’exécution, il capture des données en direct sur la pression de la mémoire, l’asymétrie des données, les modèles de lecture aléatoire et l’utilisation de l’infrastructure pendant l’exécution de la tâche.

- Intervention active : Contrairement aux outils traditionnels qui « lisent » uniquement les données, les agents de Definity peuvent « agir ». Ils peuvent modifier l’allocation des ressources en cours d’exécution, arrêter une tâche avant qu’elle ne propage des erreurs ou anticiper un pipeline s’ils détectent que les données en amont sont obsolètes.

Impact sur le monde réel : l’efficacité plutôt que l’élasticité

La valeur de cette approche est plus visible dans les environnements où les ressources sont limitées. Pour les entreprises qui exploitent une infrastructure sur site, l’incapacité d’évoluer instantanément dans le cloud signifie que chaque requête inefficace se traduit directement par un gaspillage de coûts matériels.

Nexxen, une plateforme de technologie publicitaire, sert d’étude de cas principale pour cette transition. Face aux charges de travail Spark à grande échelle sur site, l’équipe d’ingénierie de Nexxen a été confrontée non seulement à des pannes, mais également au coût croissant de l’inefficacité.

Après le déploiement de Definity, les résultats ont été immédiats :

– Optimisation : L’équipe a identifié 33 % de toutes les opportunités d’optimisation au cours de la première semaine.

– Efficacité : Les efforts de dépannage et d’optimisation ont été réduit de 70 %.

– Capacité : La plate-forme a libéré suffisamment de capacité d’infrastructure pour permettre la croissance de la charge de travail sans avoir besoin de nouveaux investissements matériels.

Les nouveaux enjeux de l’ingénierie des données

La montée en puissance de Definity signale un changement plus large dans l’industrie : Les opérations de pipeline de données deviennent un problème d’infrastructure d’IA.

À mesure que les pipelines de données passent de la prise en charge de simples tableaux de bord à l’alimentation d’agents d’IA autonomes, la marge d’erreur a disparu. La transition de « l’observation » d’une défaillance à sa « prévention » grâce à l’intelligence en cours d’exécution n’est plus seulement un luxe d’optimisation : elle devient une exigence pour la fiabilité de l’ensemble de la pile d’IA.

Conclusion

En intégrant des agents directement dans la couche d’exécution, Definity fait passer les opérations sur les données d’un modèle réactif « à réparer plus tard » à un système proactif en temps réel. Ce changement est essentiel à mesure que les entreprises évoluent vers l’IA agentique, où l’intégrité des données constitue le fondement d’une prise de décision autonome.