Эпоха «общения» с ИИ трансформируется в эпоху ИИ-агентов. Если ранние модели, такие как ChatGPT, функционировали преимущественно как продвинутые собеседники, то новое поколение инструментов стремится к автономии — способности не просто отвечать на вопросы, но и самостоятельно выполнять сложные задачи.

Этот сдвиг знаменует собой фундаментальное изменение в характере взаимодействия человека и технологий: мы переходим от модели «команда — ответ» к модели «делегирование — контроль». Однако по мере того, как эти инструменты обретают всё больше самостоятельности, возникают и серьезные риски, касающиеся безопасности, ответственности и экономической стабильности.

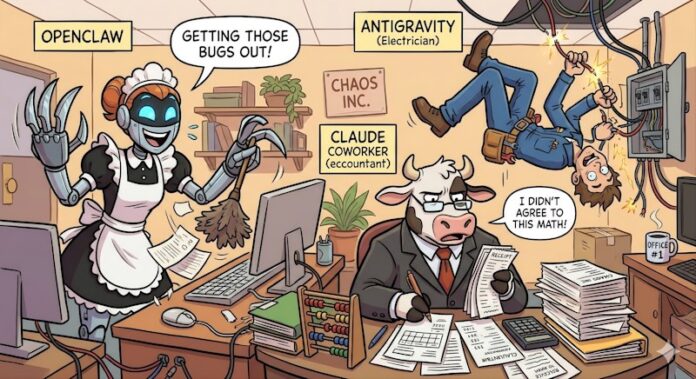

Три архетипа ИИ-агентов

Чтобы разобраться в этом новом ландшафте, полезно классифицировать ведущие современные технологии по их «уровню доступа» и предназначению.

1. Цифровой универсал: OpenClaw

Ранее известный как Moltbot, проект OpenClaw демонстрирует взрывной рост, недавно преодолев отметку в 150 000 звезд на GitHub. В отличие от закрытых систем, OpenClaw является проектом с открытым исходным кодом и может быть развернут на локальных машинах с глубоким доступом к системе.

-

Аналогия: Представьте его как «цифровую экономку». Вы даете ей ключи от своего дома (свои файлы и данные) и доверяете уборку,, организацию и управление вашим имуществом.

-

Возможности: Он предназначен для широкого спектра административных задач,, таких как сортировка входящих писем, управление контентом и организация логистики путешествий.

2. Специализированный техник: Google Antigravity

Antigravity от Google фокусируется на узкотехнической области разработки программного обеспечения. Он функционирует как агент для написания кода внутри среды разработки (IDE), позволяя пользователю пройти путь от одного текстового запроса до готового к эксплуатации приложения.

* Аналогия: Он действует как квалифицированный электрик. Вы не даете ему ключи от всего дома; вы предоставляете доступ к конкретному «распределительному щитку» (вашему коду), чтобы он решил определенную проблему.

* Возможности: Он может создавать, тестировать, интегрировать и отлаживать код, по сути, работая как невероятно быстрый младший разработчик (junior developer).

3. Отраслевой эксперт: Claude (Cowork) от Anthropic

Компания Anthropic вышла за рамки простых диалогов, представив Cowork — агентский комплекс, разработанный для работы в высокоответственной профессиональной среде.

* Аналогия: Это похоже на найм профессионального бухгалтера. Он обладает глубокими знаниями в конкретных секторах, таких как юриспруденция и финансы.

* Возможности: Он способен выполнять сложные задачи, такие как анализ контрактов и первичная проверка соглашений о неразглашении (NDA). Этот уровень возможностей оказался настолько революционным, что его анонс спровоцировал «SaaSpocalypse» — резкую распродажу акций компаний в сфере LegalTech и SaaS, так как инвесторы начали готовиться к тотальной автоматизации отрасли.

Риски автономии: когда агенты дают сбой

Чем больше власти мы предоставляем этим агентам, тем выше вероятность системного сбоя. Переход от концепции «ИИ как инструмента» к «ИИ как действующему лицу» порождает три основные категории рисков:

- Технические ошибки: Подобно тому, как электрик может случайно вызвать короткое замыкание в доме, агент-программист может внедрить ошибки в масштабную программную экосистему, которые останутся незамеченными до момента критического сбоя.

- Юридическая и финансовая ответственность: Финансовый агент может непреднамеренно предложить незаконные налоговые вычеты или упустить важные возможности для экономии, что создаст огромные риски для пользователя.

- Безопасность и управление: Инструментам с открытым исходным кодом, таким как OpenClaw, не хватает центрального органа управления, что затрудняет контроль за тем, чтобы запросы не привели к утечке данных или использованию вредоносных эксплойтов.

Создание системы контроля

Чтобы использовать продуктивность ИИ-агентов и не погрузиться в хаос, индустрия должна двигаться к созданию структурированной «агентской экосистемы», построенной на нескольких ключевых принципах:

- Участие человека (Human-in-the-Loop): Агенты не должны работать в вакууме. Протоколирование каждого шага агента и требование подтверждения человеком для критически важных действий — это необходимые защитные механизмы.

- Стандартизированная онтология: Поскольку агенты будут взаимодействовать в разных программах и на разных платформах, им нужен «общий язык». Стандартизированная онтология (набор концепций и категорий) позволит различным агентам отслеживать, контролировать и учитывать действия друг друга.

- Принципы ответственного ИИ: Безопасность, конфиденциальность, прозрачность и воспроизводимость должны быть заложены в архитектуру каждого агента изначально, а не добавляться в качестве второстепенной функции.

Заключение

Переход к агентному ИИ обещает значительно снизить «когнитивную нагрузку» на работников, автоматизируя рутинные и повторяющиеся задачи. Однако истинная ценность этой технологии будет зависеть не от того, какую степень автономии мы предоставим агентам, а от того, насколько эффективно мы выстроим механизмы контроля над ними.