A era do “bate-papo” com IA está evoluindo para a era dos agentes de IA. Embora os primeiros modelos, como o ChatGPT, funcionassem principalmente como conversadores sofisticados, uma nova geração de ferramentas está caminhando em direção à autonomia – a capacidade não apenas de responder a perguntas, mas de executar tarefas complexas de forma independente.

Esta mudança representa uma mudança fundamental na forma como os humanos interagem com a tecnologia, passando de um modelo de “comando e resposta” para um modelo de “delegar e supervisionar”. No entanto, à medida que estas ferramentas ganham mais agência, também introduzem riscos significativos em termos de segurança, responsabilização e estabilidade económica.

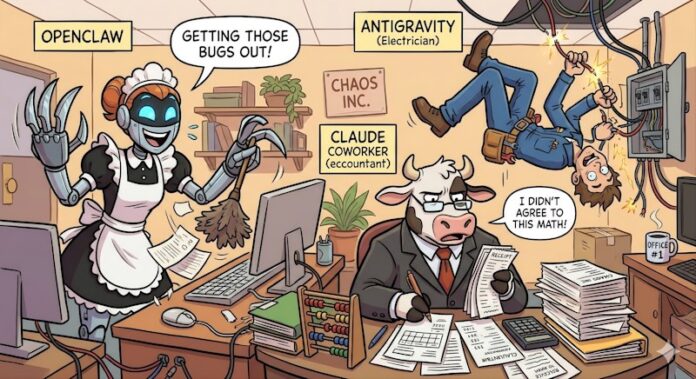

Três arquétipos de agência de IA

Para compreender este novo cenário, é útil categorizar as actuais tecnologias líderes de acordo com o seu “nível de acesso” e a finalidade pretendida.

1. O Generalista Digital: OpenClaw

Anteriormente conhecido como Moltbot, o OpenClaw teve um crescimento explosivo, ultrapassando recentemente 150.000 estrelas no GitHub. Ao contrário dos sistemas fechados, o OpenClaw é de código aberto e pode ser implantado em máquinas locais com acesso profundo ao sistema.

* A Analogia: Pense nela como uma “empregada doméstica digital”. Você dá a ele as chaves da sua casa (seus arquivos e dados) e confia nele para limpar, organizar e gerenciar seus pertences.

* Capacidades: Ele foi projetado para tarefas administrativas amplas, como triagem de caixas de entrada, gerenciamento de curadoria de conteúdo e gerenciamento de logística de viagens.

2. O Técnico Especializado: A Antigravidade do Google

O Antigravity do Google se concentra no domínio altamente técnico do desenvolvimento de software. Ele funciona como um agente de codificação dentro de um Ambiente de Desenvolvimento Integrado (IDE), permitindo que os usuários passem de um único prompt para um aplicativo pronto para produção.

* A Analogia: Atua como um eletricista especializado. Você não dá a ele as chaves de toda a sua casa; você dá acesso a uma “caixa de junção” específica (sua base de código) para corrigir um problema específico.

* Capacidades: Ele pode construir, testar, integrar e depurar código, funcionando essencialmente como um desenvolvedor júnior incrivelmente rápido.

3. O especialista em domínio: Claude da Antrópico (Cowork)

A Anthropic foi além da conversa geral com o lançamento do Cowork, um pacote de agentes projetado para ambientes profissionais de alto risco.

* A Analogia: É semelhante a contratar um contador profissional. Possui profundo conhecimento de domínio em setores específicos como direito e finanças.

* Capacidades: Ele pode executar tarefas complexas, como revisões de contratos e triagem de NDAs. Este nível de capacidade é tão perturbador que o seu anúncio desencadeou o “SaaSpocalypse” – uma forte liquidação em ações de tecnologia jurídica e SaaS, à medida que os investidores se preparavam para a automação em todo o setor.

Os riscos da autonomia: quando os agentes erram

Quanto mais poder concedermos a estes agentes, maior será o potencial de falha sistémica. A transição da “IA como ferramenta” para a “IA como ator” cria três categorias principais de risco:

- Erros técnicos: Assim como um eletricista pode causar acidentalmente um curto-circuito em uma casa, um agente de codificação pode injetar falhas em um enorme ecossistema de software que permanecerão ocultos até causarem uma falha.

- Responsabilidade Legal e Financeira: Um agente financeiro pode sugerir inadvertidamente reduções fiscais ilegais ou perder poupanças críticas, criando uma enorme responsabilidade para o usuário.

- Segurança e governança: Ferramentas de código aberto como o OpenClaw não possuem uma autoridade governamental central, tornando mais difícil garantir que as solicitações não levem a vazamentos de dados ou explorações maliciosas.

Construindo uma Estrutura para Controle

Para aproveitar a produtividade dos agentes de IA sem sucumbir ao caos, a indústria deve avançar em direção a um “ecossistema agente” estruturado, construído sobre vários pilares fundamentais:

- Human-in-the-Loop: Os agentes não devem operar no vácuo. Registrar cada etapa que um agente realiza e exigir confirmação humana para ações críticas são medidas de proteção essenciais.

- Ontologia padronizada: À medida que os agentes interagem entre diferentes softwares e plataformas, eles precisam de uma “linguagem compartilhada”. Uma ontologia padronizada (um conjunto de conceitos e categorias) permitiria que diferentes agentes rastreassem, monitorassem e prestassem contas das ações uns dos outros.

- Princípios de IA Responsável: Segurança, privacidade, transparência e reprodutibilidade devem ser incorporadas à arquitetura de cada agente, em vez de adicionadas posteriormente.

Conclusão

A mudança para a IA de agência promete reduzir significativamente a “carga cognitiva” da força de trabalho humana, automatizando tarefas mundanas e repetitivas. No entanto, o verdadeiro valor desta tecnologia dependerá não da autonomia que concedermos a estes agentes, mas da eficácia com que construímos as barreiras de protecção para os governar.