Databricks revelou KARL (Agentes de Conhecimento via Reinforcement Learning), um novo agente de IA projetado para superar as limitações dos pipelines tradicionais de Geração Aumentada de Recuperação (RAG). A maioria dos sistemas RAG empresariais se destacam em um tipo de pesquisa, falhando silenciosamente quando confrontados com outros. Um modelo otimizado para síntese de relatórios terá dificuldades com a recuperação precisa de entidades, enquanto um modelo focado em pesquisa falhará no raciocínio em várias etapas. KARL pretende resolver isso sendo treinado para lidar simultaneamente com seis comportamentos distintos de pesquisa empresarial.

O problema com os sistemas RAG atuais

Os sistemas RAG existentes são frágeis. Eles normalmente são ajustados para tarefas de pesquisa específicas, deixando-os vulneráveis quando confrontados com a complexidade do mundo real. Um agente treinado para responder a perguntas simples pode entrar em colapso quando for encarregado de reconstruir registros internos fragmentados ou sintetizar informações a partir de notas de reuniões não estruturadas. Essa inflexibilidade força as equipes a criar pipelines separados para cada caso de uso, criando sobrecarga de manutenção e acesso isolado ao conhecimento.

Como funciona o KARL: aprendizado por reforço multitarefa

A Databricks treinou KARL usando um novo algoritmo de aprendizagem por reforço (RL), alcançando desempenho comparável ao Claude Opus 4.6 com um custo por consulta 33% menor e latência 47% menor. Crucialmente, o modelo foi treinado inteiramente em dados sintéticos gerados por ele mesmo, eliminando a necessidade de rotulagem humana dispendiosa. Isso foi possível por causa do OAPL, uma política de Otimização de Política baseada em Vantagem Ideal com Inferência Lagged, que a Databricks co-desenvolveu com pesquisadores de Cornell e Harvard.

A principal inovação do OAPL é a sua estabilidade em ambientes de treinamento distribuídos. Ao contrário das abordagens tradicionais de LLM RL, ele lida com atrasos de política de forma eficaz, permitindo treinamento com eficiência de amostra e reduzindo custos de GPU. Isso torna o modelo viável para implantação empresarial realista.

Seis comportamentos de pesquisa empresarial tratados por KARL

Para avaliar o KARL, a Databricks criou o KARLBench, um benchmark que avalia o desempenho em seis comportamentos críticos de pesquisa empresarial:

- Pesquisa de entidade orientada por restrições: Recuperação de entidades específicas sob condições estritas.

- Síntese de relatórios entre documentos: Combinação de informações de diversas fontes em um relatório coerente.

- Travessia de documentos longos com raciocínio tabular: Extração de insights de documentos grandes com dados numéricos.

- Recuperação exaustiva de entidades: Identificação de todas as entidades relevantes em um determinado conjunto de dados.

- Raciocínio processual sobre documentação técnica: Seguindo instruções passo a passo de manuais complexos.

- Agregação de fatos em notas internas da empresa: Combinação de dados fragmentados para responder a perguntas complexas.

O KARL demonstrou forte generalização, tendo um bom desempenho em tarefas nas quais nunca foi explicitamente treinado, ao contrário dos sistemas RAG padrão.

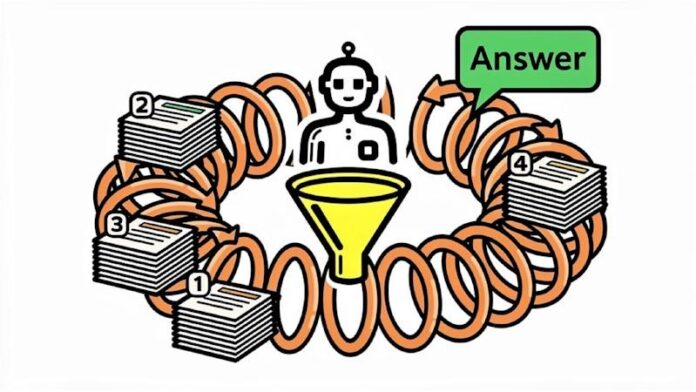

A camada de compactação: gerenciamento de contexto

Um grande desafio na pesquisa corporativa é gerenciar a janela de contexto dos Large Language Models (LLMs). Os sistemas RAG tradicionais dependem de enormes bancos de dados de vetores ou forçam os LLMs a processar muitas informações de uma só vez. KARL aborda isso aprendendo a compactar seu próprio contexto de ponta a ponta por meio de RL. Quando o contexto excede os limites do LLM, o agente o compacta, mantendo a precisão enquanto permanece dentro dos limites. Sem essa compressão o desempenho do modelo cai significativamente.

Limitações e roteiro futuro

KARL luta com consultas com ambiguidade inerente, onde existem múltiplas respostas válidas. O modelo às vezes desiste antecipadamente de consultas complexas, o que a Databricks argumenta ser muitas vezes o comportamento correto para eficiência de custos. Atualmente, o KARL suporta apenas pesquisa vetorial; a integração com bancos de dados SQL, sistemas de arquivos e cálculos baseados em Python está planejada para desenvolvimento futuro.

Implicações para equipes de dados empresariais

KARL destaca três considerações cruciais para as equipes que constroem sua infraestrutura de recuperação:

- A arquitetura do pipeline é importante: Pipelines RAG estreitamente otimizados falharão em diversos tipos de consulta.

- Aprendizado por reforço é fundamental: A destilação de modelos especialistas não pode corresponder às capacidades de generalização de agentes treinados em RL.

- Eficiência é mais que custo: Agentes de pesquisa específicos concluem tarefas com mais rapidez, reduzem consultas desperdiçadas e compactam o contexto de maneira eficaz.

Construir um modelo que saiba como pesquisar é mais valioso do que simplesmente rotear tudo por meio de APIs de uso geral.