Decennia lang heeft technologische vooruitgang het vertrouwen in deskundigen uitgehold, het publieke debat gepolariseerd en individuen in de richting van een steeds persoonlijkere realiteit gedreven. Hoewel sociale media deze trend hebben versneld, kan kunstmatige intelligentie een verrassende tegenkracht bieden, waardoor mogelijk enige consensus over de feitelijke realiteit wordt hersteld. Deze verschuiving is niet gegarandeerd, maar de economische prikkels en inherente mogelijkheden van AI suggereren een mogelijke omkering van de ergste gevolgen van sociale media.

De erosie van de gedeelde realiteit

Halverwege de 20e eeuw beheersten beperkte uitzendmogelijkheden – ABC, NBC en CBS – de nieuwsstroom effectief. Deze omgeving bevorderde een brede overeenstemming over fundamentele feiten, maar maakte ook misleiding door de overheid mogelijk. De hoge productiekosten en strenge regelgevende controles zorgden ervoor dat minder stemmen de publieke sfeer domineerden. Dit was niet noodzakelijkerwijs een gouden tijdperk van de waarheid, maar het creëerde wel een gedeelde basis van begrip.

De opkomst van kabeltelevisie en vervolgens internet heeft dit model vernietigd. De kabel introduceerde nichenetwerken als Fox News en MSNBC, die zich richtten op voorheen gemarginaliseerde standpunten. Maar het internet heeft informatie werkelijk gedemocratiseerd, waardoor de kosten voor publicatie en distributie omlaag zijn gegaan. Iedereen zou een groot publiek kunnen bereiken, zonder de traditionele poortwachters te omzeilen. Hoewel dit een grotere verantwoordelijkheid en toegang tot kennis beloofde, ontketende het ook een stortvloed aan verkeerde informatie, complottheorieën en extremistische inhoud. Algoritmen van sociale media hebben deze fragmentatie vervolgens versterkt, waardoor gebruikers op maat gemaakte streams kregen die waren ontworpen voor maximale betrokkenheid, ongeacht de nauwkeurigheid.

AI als potentieel corrigerend middel

Ondanks de angst voor deepfakes en door AI gegenereerde propaganda, zijn er steeds meer aanwijzingen dat grote taalmodellen (LLM’s) de consensus rond de feitelijke realiteit daadwerkelijk kunnen vergroten. In tegenstelling tot socialemediabedrijven die worden gestimuleerd door betrokkenheid, hebben AI-laboratoria een sterke economische reden om prioriteit te geven aan nauwkeurigheid. Advocatenkantoren, investeringsbanken en andere sectoren van de ‘kenniseconomie’ zullen niet betalen voor onbetrouwbare resultaten, waardoor AI-ontwikkelaars gedwongen worden prioriteit te geven aan waarheidsgetrouwheid.

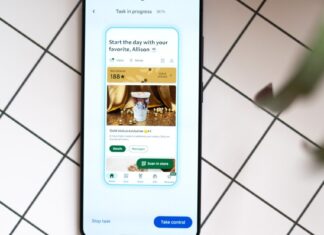

Denk aan X van Elon Musk (voorheen Twitter). Toen hem werd gevraagd naar een omstreden schietpartij, beweerde Musk ten onrechte dat het slachtoffer probeerde mensen overreden. De AI-chatbot van het platform, Grok, corrigeerde hem onmiddellijk, in lijn met de mainstream journalistieke consensus. Dit is geen geïsoleerd incident. Uit onderzoek blijkt dat LLM’s als Grok en Perplexity het vaker wel dan niet met elkaar en met professionele factcheckers eens zijn.

Bovendien is AI niet alleen accuraat, maar ook overtuigend. Onderzoek wijst uit dat interactie met LLM’s over onderwerpen als klimaatverandering of vaccinveiligheid het scepticisme kan verminderen en gebruikers in de richting van gevestigde wetenschappelijke consensus kan duwen. Dit is waarschijnlijk te danken aan het oneindige geduld van de AI en het vermogen om uitleg af te stemmen op individueel begrip, zonder emotionele bagage. Menselijke experts kunnen afwijzend of neerbuigend zijn, waardoor defensief gedrag ontstaat. LLM’s, die geen sociaal ego hebben, kunnen encyclopedische antwoorden geven zonder oordeel, waardoor het voor mensen gemakkelijker wordt om onjuiste overtuigingen toe te geven.

Er blijven kanttekeningen en risico’s bestaan

Dit convergentiepotentieel is niet zonder kanttekeningen. LLM’s kunnen worden gemanipuleerd om bestaande vooroordelen te versterken. Als een AI-aanbieder betrokkenheid belangrijker vindt dan nauwkeurigheid, kan hij gemakkelijk inspelen op sensatiezucht en echokamers. Door AI gegenereerde propaganda vormt ook een groeiende bedreiging, waardoor ‘botzwermen’ desinformatie op grote schaal kunnen verspreiden.

De sleutel is of economische prikkels in overeenstemming zullen zijn met waarheidsgetrouwheid. Als AI een hulpmiddel blijft voor gespecialiseerde industrieën die betrouwbare informatie nodig hebben, zal dit waarschijnlijk de consensus bevorderen. Als AI echter in de eerste plaats een consumentgericht entertainmentproduct wordt, kan de neiging tot sycofantie en personalisatie de bestaande problemen verergeren.

Uiteindelijk biedt AI een unieke kans om de verstorende effecten van sociale media tegen te gaan. Maar het realiseren van dit potentieel hangt af van het geven van prioriteit aan nauwkeurigheid boven betrokkenheid, en het garanderen dat de toekomst van AI wordt gedreven door nut en niet alleen door entertainment.

De opkomst van AI garandeert geen terugkeer naar een gedeelde realiteit, maar biedt wel een zeldzame kans om het vertrouwen in expertise weer op te bouwen en een beter geïnformeerd publiek debat te bevorderen.