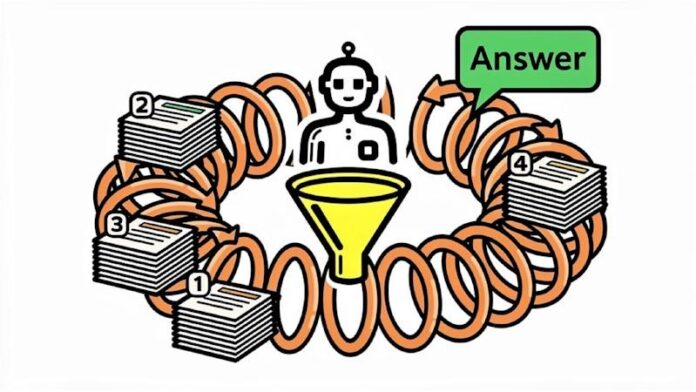

Databricks heeft KARL (Knowledge Agents via Reinforcement Learning) onthuld, een nieuwe AI-agent die is ontworpen om de beperkingen van traditionele Retrieval-Augmented Generation (RAG)-pijplijnen te overwinnen. De meeste zakelijke RAG-systemen blinken uit in één type zoekactie en falen stilletjes wanneer ze met andere worden geconfronteerd. Een model dat is geoptimaliseerd voor rapportsynthese zal moeite hebben met het nauwkeurig terugvinden van entiteiten, terwijl een op lookup gericht model zal falen bij het redeneren in meerdere stappen. KARL wil dit oplossen door getraind te worden in het gelijktijdig omgaan met zes verschillende enterprise search-gedragingen.

Het probleem met de huidige RAG-systemen

Bestaande RAG-systemen zijn broos. Ze zijn doorgaans nauwkeurig afgestemd op specifieke zoektaken, waardoor ze kwetsbaar zijn wanneer ze worden geconfronteerd met de complexiteit in de echte wereld. Een agent die is getraind in het eenvoudig beantwoorden van vragen, kan instorten als hij wordt belast met het reconstrueren van gefragmenteerde interne documenten of het synthetiseren van informatie uit ongestructureerde vergadernotities. Deze inflexibiliteit dwingt teams om voor elke gebruikssituatie afzonderlijke pijplijnen te bouwen, waardoor onderhoudsoverhead en silo-kennistoegang ontstaat.

Hoe KARL werkt: leren door meerdere taken te versterken

Databricks heeft KARL getraind met behulp van een nieuw Reinforcement Learning (RL)-algoritme, waardoor prestaties werden behaald die vergelijkbaar zijn met Claude Opus 4.6 tegen 33% lagere kosten per query en 47% lagere latentie. Cruciaal was dat het model volledig werd getraind op door zichzelf gegenereerde synthetische gegevens, waardoor dure etikettering van mensen overbodig werd. Dit was mogelijk dankzij OAPL, een op Optimal Advantage-based Policy Optimization with Lagged Inference-beleid, dat Databricks samen met onderzoekers van Cornell en Harvard ontwikkelde.

De belangrijkste innovatie van OAPL is de stabiliteit ervan in gedistribueerde trainingsomgevingen. In tegenstelling tot traditionele LLM RL-benaderingen, wordt hiermee effectief omgegaan met beleidsvertragingen, waardoor een voorbeeldefficiënte training mogelijk is en de GPU-kosten worden verlaagd. Dit maakt het model haalbaar voor realistische bedrijfsimplementatie.

Zes zoekgedrag van bedrijven afgehandeld door KARL

Om KARL te evalueren, heeft Databricks KARLBench gemaakt, een benchmark die de prestaties van zes cruciale zoekgedragingen voor ondernemingen beoordeelt:

- Constraint-driven entiteiten zoeken: Specifieke entiteiten ophalen onder strikte voorwaarden.

- Samenvatting van rapporten over meerdere documenten: Het combineren van informatie uit meerdere bronnen tot een samenhangend rapport.

- Doorkruisen van lange documenten met redeneren in tabelvorm: Inzichten extraheren uit grote documenten met numerieke gegevens.

- Uitgebreid ophalen van entiteiten: Identificatie van alle relevante entiteiten binnen een bepaalde dataset.

- Procedureel redeneren over technische documentatie: Stapsgewijze instructies volgen uit complexe handleidingen.

- Feitenaggregatie via interne bedrijfsnotities: Gefragmenteerde gegevens combineren om complexe vragen te beantwoorden.

KARL toonde een sterke generalisatie en presteerde goed op taken waarvoor het nooit expliciet was getraind, in tegenstelling tot standaard RAG-systemen.

De compressielaag: contextbeheer

Een grote uitdaging bij enterprise search is het beheren van het contextvenster van Large Language Models (LLM’s). Traditionele RAG-systemen vertrouwen op enorme vectordatabases of dwingen LLM’s om te veel informatie tegelijk te verwerken. KARL pakt dit aan door te leren zijn eigen context end-to-end te comprimeren via RL. Wanneer de context de limieten van de LLM overschrijdt, comprimeert de agent deze, waardoor de nauwkeurigheid behouden blijft en binnen de grenzen blijft. Zonder deze compressie nemen de prestaties van het model aanzienlijk af.

Beperkingen en toekomstige routekaart

KARL worstelt met vragen met inherente dubbelzinnigheid, waarbij meerdere geldige antwoorden bestaan. Het model geeft complexe query’s soms vroegtijdig op, wat volgens Databricks vaak het juiste gedrag is voor kostenefficiëntie. Momenteel ondersteunt KARL alleen zoeken naar vectoren; Integratie met SQL-databases, bestandssystemen en op Python gebaseerde berekeningen is gepland voor toekomstige ontwikkeling.

Implicaties voor ondernemingsdatateams

KARL benadrukt drie cruciale overwegingen voor teams die hun ophaalinfrastructuur bouwen:

- Pijplijnarchitectuur is belangrijk: Nauwelijk geoptimaliseerde RAG-pijplijnen zullen mislukken bij verschillende querytypen.

- Versterkingsleren is essentieel: Distillatie uit expertmodellen kan niet tippen aan de generalisatiemogelijkheden van RL-opgeleide agenten.

- Efficiëntie is meer dan alleen kosten: Speciaal gebouwde zoekagenten voltooien taken sneller, verminderen het aantal verspilde zoekopdrachten en comprimeren de context effectief.

Het bouwen van een model dat weet hoe te zoeken is waardevoller dan simpelweg alles via algemene API’s te routeren.