L’era della “chat” con l’intelligenza artificiale si sta evolvendo nell’era degli agenti IA. Mentre i primi modelli come ChatGPT funzionavano principalmente come sofisticati conversatori, una nuova generazione di strumenti si sta muovendo verso l’autonomia, ovvero la capacità non solo di rispondere alle domande, ma di eseguire compiti complessi in modo indipendente.

Questo cambiamento rappresenta un cambiamento fondamentale nel modo in cui gli esseri umani interagiscono con la tecnologia, passando da un modello di “comando e risposta” a un modello di “delega e supervisione”. Tuttavia, man mano che questi strumenti acquisiscono maggiore potere, introducono anche rischi significativi in termini di sicurezza, responsabilità e stabilità economica.

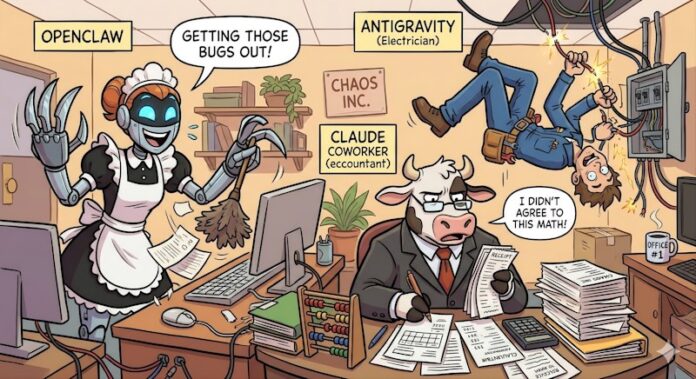

Tre archetipi dell’agenzia AI

Per comprendere questo nuovo panorama, è utile classificare le attuali tecnologie leader in base al loro “livello di accesso” e allo scopo previsto.

1. Il generalista digitale: OpenClaw

Precedentemente noto come Moltbot, OpenClaw ha registrato una crescita esplosiva, superando recentemente le 150.000 stelle GitHub. A differenza dei sistemi chiusi, OpenClaw è open source e può essere distribuito su macchine locali con accesso approfondito al sistema.

* L’analogia: Considerala una “cameriera digitale”. Gli dai le chiavi di casa tua (i tuoi file e dati) e ti fidi di lui per pulire, organizzare e gestire le tue cose.

* Funzionalità: è progettato per attività amministrative di ampio respiro, come la valutazione delle caselle di posta, la gestione della cura dei contenuti e la gestione della logistica dei viaggi.

2. Il Tecnico Specializzato: l’Antigravità di Google

Antigravity di Google si concentra sull’ambito altamente tecnico dello sviluppo del software. Funziona come un agente di codifica all’interno di un ambiente di sviluppo integrato (IDE), consentendo agli utenti di passare da un singolo prompt a un’applicazione pronta per la produzione.

* L’analogia: Si comporta come un elettricista specializzato. Non gli dai le chiavi di tutta la tua casa; gli dai accesso a una specifica “scatola di giunzione” (la tua codebase) per risolvere un problema specifico.

* Funzionalità: Può creare, testare, integrare ed eseguire il debug del codice, funzionando essenzialmente come uno sviluppatore junior incredibilmente veloce.

3. L’esperto di dominio: Claude di Anthropic (Cowork)

Anthropic è andato oltre la conversazione generale con l’introduzione di Cowork, una suite per agenti progettata per ambienti professionali ad alto rischio.

* L’analogia: È come assumere un contabile professionista. Possiede una profonda conoscenza del dominio in settori specifici come il diritto e la finanza.

* Funzionalità: Può eseguire attività complesse come revisioni dei contratti e triage NDA. Questo livello di capacità è così dirompente che il suo annuncio ha innescato la “SaaSpocalypse”, una forte svendita dei titoli SaaS e della tecnologia legale mentre gli investitori si preparavano all’automazione a livello di settore.

I rischi dell’autonomia: quando gli agenti vanno male

Maggiore è il potere che concediamo a questi agenti, maggiore è il rischio di fallimento sistemico. La transizione da “AI come strumento” a “AI come attore” crea tre categorie principali di rischio:

- Errori tecnici: Proprio come un elettricista potrebbe cortocircuitare accidentalmente una casa, un agente di codifica potrebbe inserire difetti in un enorme ecosistema software che rimangono nascosti finché non causano un arresto anomalo.

- Responsabilità legale e finanziaria: un agente finanziario potrebbe inavvertitamente suggerire cancellazioni fiscali illegali o perdere risparmi critici, creando enormi responsabilità per l’utente.

- Sicurezza e governance: gli strumenti open source come OpenClaw non hanno un’autorità di governo centrale, il che rende più difficile garantire che le richieste non portino a fughe di dati o exploit dannosi.

Costruire una struttura per il controllo

Per sfruttare la produttività degli agenti IA senza soccombere al caos, il settore deve muoversi verso un “ecosistema agenti” strutturato costruito su diversi pilastri chiave:

- Human-in-the-Loop: gli agenti non dovrebbero operare nel vuoto. La registrazione di ogni passo compiuto da un agente e la richiesta di conferma umana per azioni critiche sono protezioni essenziali.

- Ontologia standardizzata: poiché gli agenti interagiscono su diversi software e piattaforme, hanno bisogno di un “linguaggio condiviso”. Un’ontologia standardizzata (un insieme di concetti e categorie) consentirebbe a diversi agenti di tracciare, monitorare e rendere conto delle azioni degli altri.

- Principi di intelligenza artificiale responsabile: Sicurezza, privacy, trasparenza e riproducibilità devono essere integrate nell’architettura di ogni agente, anziché aggiunte come ripensamento.

Conclusione

Il passaggio all’IA agente promette di ridurre significativamente il “carico cognitivo” sulla forza lavoro umana automatizzando compiti banali e ripetitivi. Tuttavia, il vero valore di questa tecnologia dipenderà non da quanta autonomia concederemo a questi agenti, ma da quanto efficacemente costruiremo i guardrail per governarli.