L’evoluzione dell’Intelligenza Artificiale ha raggiunto un punto di flessione critico. Stiamo superando l’era delle semplici interazioni “domande e risposte”, del tipo reso popolare dalle prime iterazioni di ChatGPT, ed entrando nell’era dell’intelligenza artificiale. A differenza dei chatbot standard, questi nuovi agenti autonomi non si limitano a parlare; agiscono.

Questo cambiamento rappresenta un cambiamento fondamentale nel modo in cui gli esseri umani interagiscono con la tecnologia, passando da strumenti passivi a collaboratori attivi. Tuttavia, questa transizione comporta sia un immenso potenziale di produttività che significativi rischi sistemici.

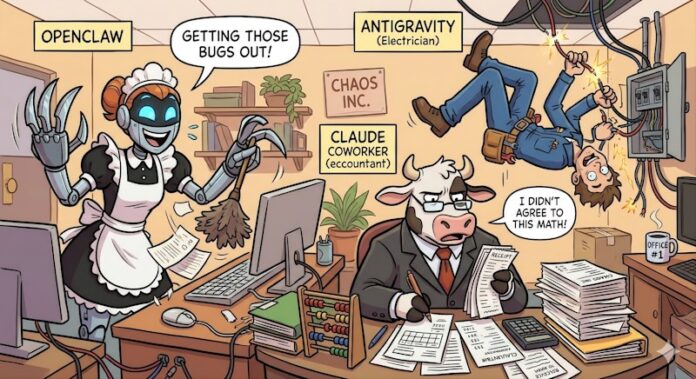

Una nuova classe di lavoratori digitali

Per comprendere questo nuovo panorama, è utile classificare gli strumenti emergenti in base alla loro funzione e al livello di autonomia loro concesso. Gli attuali leader di mercato possono essere visti attraverso tre lenti distinte:

1. La “cameriera” generalista: OpenClaw

Precedentemente noto come Moltbot e Clawdbot, OpenClaw ha registrato una crescita esplosiva, accumulando oltre 150.000 stelle GitHub in pochi giorni. Funziona come un generalista ad alto accesso. Proprio come un lavoratore domestico a cui vengono consegnate le chiavi di casa, OpenClaw è progettato per gestire file, selezionare le caselle di posta, curare contenuti e pianificare viaggi. Poiché è open source, offre un accesso approfondito al sistema, consentendogli di eseguire diverse attività nell’ambiente digitale di un utente.

2. L'”elettricista” specializzato: l’Antigravità di Google

Antigravity di Google rappresenta il professionista specializzato. Questo agente di codifica opera all’interno di un ambiente di sviluppo integrato (IDE), accelerando la transizione da un semplice prompt a un prodotto finito. Funziona come un elettricista esperto: è altamente competente in un dominio specifico (codifica, test e integrazione di software) e gli viene concesso l’accesso solo alla “scatola di giunzione” della base di codice che deve riparare o costruire.

3. L’esperto del settore “Ragioniere”: Claude di Anthropic (Cowork)

Anthropic ha trasformato Claude da chatbot generico a professionista specializzato tramite Cowork. Concentrandosi sulle conoscenze specifiche del settore, come le revisioni dei contratti legali e il triage NDA, Claude ora agisce come un contabile. Possiede una profonda esperienza in settori come il diritto e la finanza, gestendo dati sensibili per completare compiti complessi e ad alto rischio. Questa capacità è così dirompente che ha già innescato la volatilità del mercato, spesso definita “SaaSpocalypse,” che ha un impatto sui titoli SaaS e legal-tech.

I rischi dell’autonomia: dagli errori al “caos”

Più potere concediamo a questi agenti, più alta diventa la posta in gioco. Il passaggio da “strumento” ad “agente” introduce tre categorie principali di rischio:

- Guasto sistemico: Proprio come un elettricista inesperto potrebbe cortocircuitare una casa, un agente di intelligenza artificiale potrebbe inserire un codice difettoso o interrompere inavvertitamente i sistemi interconnessi.

- Responsabilità legale e finanziaria: un agente specializzato come Claude potrebbe fornire consulenza fiscale errata, perdere risparmi cruciali o, peggio ancora, suggerire cancellazioni illegali che portano a conseguenze normative.

- Lacune nella governance: mentre i fornitori centralizzati come Google e Anthropic possono implementare protocolli di sicurezza, i modelli open source come OpenClaw non hanno un’autorità centrale per applicare i guardrail, il che li rende più difficili da regolamentare e più inclini ad abusi.

Costruire una struttura per la fiducia

Per sfruttare i vantaggi dell’intelligenza artificiale senza soccombere al caos, il settore deve muoversi verso un ecosistema strutturato basato sui principi dell’intelligenza artificiale responsabile. Ciò richiede molto più che un semplice codice migliore; richiede una nuova serie di standard operativi:

- Human-in-the-Loop: le azioni critiche devono richiedere la conferma umana e ogni passo compiuto da un agente deve essere meticolosamente registrato per garantirne la responsabilità.

- Ontologia standardizzata: poiché gli agenti interagiscono tra sistemi diversi, hanno bisogno di un “linguaggio condiviso”. L’implementazione di un’ontologia specifica del dominio garantisce che le azioni vengano tracciate, monitorate e comprese sia dagli esseri umani che dalle altre macchine.

- Identità e sicurezza distribuite: la creazione di strutture per l’identità e la fiducia consentirà agli agenti di operare in modo sicuro all’interno di infrastrutture digitali complesse.

L’obiettivo: Se implementata con rigorosa trasparenza e sicurezza, l’intelligenza artificiale degli agenti non sostituirà gli esseri umani ma scaricherà invece il “carico cognitivo” dei compiti banali, consentendo alla forza lavoro di concentrarsi su attività strategiche, creative e di alto valore.

Conclusione: La transizione all’intelligenza artificiale offre un enorme balzo in avanti in termini di produttività, ma il suo successo dipende dalla nostra capacità di implementare rigidi guardrail, comunicazioni standardizzate e supervisione umana per gestire i rischi intrinseci dell’autonomia.