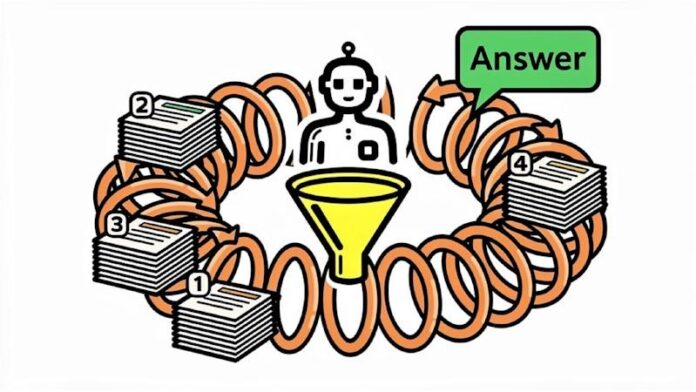

Databricks ha presentato KARL (Knowledge Agents via Reinforcement Learning), un nuovo agente AI progettato per superare i limiti delle tradizionali pipeline di Retrieval-Augmented Generation (RAG). La maggior parte dei sistemi RAG aziendali eccellono in un tipo di ricerca, fallendo silenziosamente quando confrontati con altri. Un modello ottimizzato per la sintesi dei report avrà difficoltà nel recupero preciso delle entità, mentre un modello incentrato sulla ricerca vacillerà nel ragionamento in più fasi. KARL mira a risolvere questo problema formandosi per gestire simultaneamente sei distinti comportamenti di ricerca aziendale.

Il problema con gli attuali sistemi RAG

I sistemi RAG esistenti sono fragili. Sono generalmente ottimizzati per attività di ricerca specifiche, rendendoli vulnerabili di fronte alla complessità del mondo reale. Un agente addestrato a rispondere a semplici domande può collassare quando gli viene assegnato il compito di ricostruire documenti interni frammentati o sintetizzare informazioni da appunti di riunione non strutturati. Questa inflessibilità costringe i team a creare pipeline separate per ciascun caso d’uso, creando costi di manutenzione e accesso alla conoscenza in compartimenti stagni.

Come funziona KARL: apprendimento per rinforzo multi-task

Databricks ha addestrato KARL utilizzando un nuovo algoritmo di apprendimento per rinforzo (RL), ottenendo prestazioni paragonabili a Claude Opus 4.6 con un costo per query inferiore del 33% e una latenza inferiore del 47%. Fondamentalmente, il modello è stato addestrato interamente su dati sintetici generati da solo, eliminando la necessità di costose etichettature umane. Ciò è stato possibile grazie a OAPL, una politica di ottimizzazione delle politiche basata su Optimal Advantage con Lagged Inference, che Databricks ha sviluppato in collaborazione con ricercatori di Cornell e Harvard.

L’innovazione chiave dell’OAPL è la sua stabilità negli ambienti di formazione distribuiti. A differenza degli approcci tradizionali LLM RL, gestisce i ritardi delle policy in modo efficace, consentendo una formazione efficiente a livello di campione e riducendo i costi della GPU. Ciò rende il modello praticabile per un’implementazione aziendale realistica.

Sei comportamenti di ricerca aziendale gestiti da KARL

Per valutare KARL, Databricks ha creato KARLBench, un benchmark che valuta le prestazioni in sei comportamenti di ricerca aziendali critici:

- Ricerca di entità basata su vincoli: recupero di entità specifiche in condizioni rigorose.

- Sintesi di report tra documenti: combinazione di informazioni provenienti da più fonti in un report coerente.

- Attraversamento di documenti lunghi con ragionamento tabellare: Estrazione di approfondimenti da documenti di grandi dimensioni con dati numerici.

- Recupero esaustivo delle entità: identificazione di tutte le entità rilevanti all’interno di un determinato set di dati.

- Ragionamento procedurale sulla documentazione tecnica: Seguire istruzioni passo passo da manuali complessi.

- Aggregazione di fatti su note aziendali interne: Combinazione di dati frammentati per rispondere a domande complesse.

KARL ha dimostrato una forte generalizzazione, ottenendo buoni risultati su compiti per i quali mai è stato esplicitamente addestrato, a differenza dei sistemi RAG standard.

Il livello di compressione: gestione del contesto

Una delle sfide principali nella ricerca aziendale è la gestione della finestra di contesto dei Large Language Models (LLM). I sistemi RAG tradizionali si basano su enormi database vettoriali o costringono i LLM a elaborare troppe informazioni contemporaneamente. KARL affronta questo problema imparando a comprimere il proprio contesto end-to-end tramite RL. Quando il contesto supera i limiti del LLM, l’agente lo comprime, mantenendo la precisione pur rimanendo entro i limiti. Senza questa compressione, le prestazioni del modello diminuiscono notevolmente.

Limitazioni e tabella di marcia futura

KARL ha difficoltà con domande con ambiguità intrinseca, in cui esistono più risposte valide. Il modello a volte rinuncia presto a query complesse, cosa che secondo Databricks è spesso il comportamento corretto per l’efficienza dei costi. Attualmente KARL supporta solo la ricerca vettoriale; per lo sviluppo futuro è prevista l’integrazione con database SQL, file system e calcoli basati su Python.

Implicazioni per i team dati aziendali

KARL evidenzia tre considerazioni cruciali per i team che costruiscono la propria infrastruttura di recupero:

- L’architettura della pipeline è importante: le pipeline RAG strettamente ottimizzate falliranno su diversi tipi di query.

- L’apprendimento per rinforzo è fondamentale: la distillazione da modelli esperti non può eguagliare le capacità di generalizzazione degli agenti formati in RL.

- L’efficienza è più del costo: Gli agenti di ricerca appositamente realizzati completano le attività più velocemente, riducono le query inutili e comprimono il contesto in modo efficace.

Costruire un modello che sa effettuare ricerche è più prezioso che instradare semplicemente tutto attraverso API generiche.