Dans le cadre d’un changement important dans l’architecture de sa plate-forme, Roblox a annoncé un nouveau système de classification des comptes en fonction de l’âge. Cette décision vise à mieux protéger les jeunes utilisateurs en segmentant la communauté en groupes d’âge spécifiques, chacun avec des restrictions d’accès au contenu et de communication adaptées.

La nouvelle structure de compte

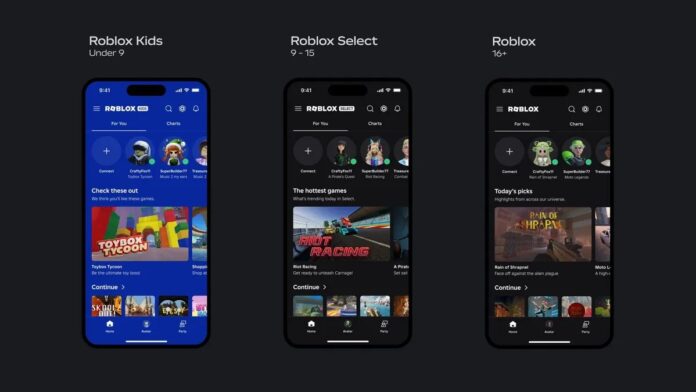

À partir de début juin, Roblox s’éloignera d’une approche unique pour classer les utilisateurs en trois niveaux distincts :

- Roblox Kids (5 à 8 ans) : Conçu pour les plus jeunes utilisateurs, doté des protections les plus strictes.

- Roblox Select (9 à 15 ans) : Un niveau intermédiaire pour les enfants plus âgés et les jeunes adolescents.

- Roblox (16 ans et plus) : L’expérience de compte standard pour les utilisateurs plus âgés et les adultes.

Pour éviter toute confusion, la plate-forme mettra en œuvre des traitements d’arrière-plan visuels distincts au sein de l’application, rendant immédiatement évident le type de compte actuellement actif. L’attribution de l’âge sera gérée via la technologie mondiale de vérification de l’âge de Roblox ou via une vérification directe par un parent.

Renforcer la sécurité grâce aux restrictions

Le principal moteur de ces changements est la nécessité d’atténuer les risques associés aux interactions non surveillées. Roblox a toujours fait l’objet d’un examen minutieux concernant ses fonctions de chat, qui ont été liées à des incidents de toilettage en ligne et de comportements prédateurs.

Pour remédier à ces vulnérabilités, les nouveaux niveaux introduisent des limitations spécifiques sur les interactions sociales et le contenu :

1. Contrôles des communications

- Pour les comptes « Enfants » : Le chat sur la plateforme sera désactivé par défaut.

- Pour les comptes « Sélectionner » : La fonctionnalité de chat sera « progressivement introduite » parallèlement à des garanties spécifiques pour garantir la sécurité à mesure que les utilisateurs mûrissent.

2. Filtrage de maturité du contenu

- Les utilisateurs « Enfants » n’auront accès qu’aux jeux étiquetés avec une maturité de contenu Minimale ou Légère.

- Les utilisateurs « sélectionnés » seront limités aux jeux avec des étiquettes de maturité de contenu Modérée.

“En matière de sécurité, nous faisons ce qu’il faut… parce que le bien-être de notre communauté est notre priorité absolue”, a déclaré David Baszucki, PDG et fondateur de Roblox.

Le contexte plus large : une poussée mondiale en faveur de la vérification

Cette décision de Roblox ne se produit pas de manière isolée. Cela reflète une tendance réglementaire mondiale croissante selon laquelle les gouvernements exigent de plus en plus que les plateformes numériques assument la responsabilité proactive de la protection des mineurs. Du Royaume-Uni à divers États américains, de nouvelles lois poussent à des processus de vérification de l’âge plus stricts, exigeant souvent des pièces d’identité gouvernementales ou un consentement parental explicite.

L’industrie est actuellement confrontée à un difficile exercice d’équilibre entre sécurité et confidentialité des utilisateurs. Alors que des entreprises comme Google (YouTube), OpenAI et Discord explorent toutes les technologies de vérification de l’âge, y compris l’estimation de l’âge basée sur l’IA, le déploiement est rarement fluide. Discord, par exemple, a fait face à des réactions négatives importantes lorsqu’il a tenté de mettre en œuvre des exigences similaires, ce qui a entraîné des retards dans ses plans.

En mettant en œuvre ces comptes à plusieurs niveaux, Roblox tente de garder une longueur d’avance sur les pressions réglementaires tout en répondant aux problèmes de sécurité spécifiques qui ont harcelé la plateforme ces dernières années.

Conclusion

En segmentant sa base d’utilisateurs en niveaux spécifiques à l’âge, Roblox tente de créer un environnement plus contrôlé qui équilibre le jeu social avec les garde-corps de sécurité essentiels. Ce changement marque une étape cruciale dans les efforts de la plateforme pour atténuer les risques tels que le toilettage et l’exposition de contenus inappropriés dans un contexte de pression réglementaire mondiale croissante.