Meta a dévoilé la troisième génération de ses « Segment Anything Models » (SAM), une suite d’outils d’IA conçus pour une analyse visuelle avancée. Bien qu’ils soient distincts des grands modèles de langage Llama populaires de Meta, ces nouveaux systèmes représentent une avancée significative dans la façon dont les machines « voient » et interagissent avec le monde physique. SAM 3 se concentre sur la détection et la segmentation précises des objets, ce qui signifie qu’il peut identifier et isoler avec précision les éléments dans les images et les vidéos.

Comment fonctionne SAM 3 : compréhension visuelle précise

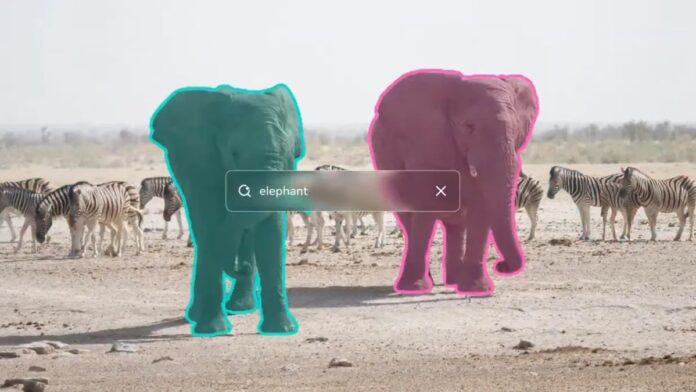

Contrairement aux chatbots IA, les modèles SAM excellent dans la reconnaissance d’objets spécifiques, même dans des scènes complexes. Meta a formé SAM 3 sur des ensembles de données massifs d’images et de vidéos associés à des descriptions textuelles détaillées. Cela permet à l’IA de répondre à des demandes très précises : par exemple sélectionner tous les éléphants sur une photo ou mettre en avant les « chapeaux rouges » dans une foule. La capacité du modèle à interpréter des requêtes nuancées constitue son principal point fort.

Ces modèles ne sont pas destinés à créer de nouvelles images ou vidéos, mais à analyser le contenu visuel existant. Les développeurs peuvent accéder aux versions à poids ouvert via Segment Anything Playground de Meta. Cependant, le véritable impact sera ressenti par les utilisateurs quotidiens grâce aux améliorations apportées aux propres plateformes de Meta.

Applications pratiques : des médias sociaux à la conservation de la faune

Meta intègre SAM 3 dans plusieurs de ses produits :

- Modifications et vibrations Instagram : Permet une édition par lots plus précise d’images et de vidéos.

- Facebook Marketplace : Amélioration de la fonctionnalité « vue dans une pièce », permettant aux utilisateurs de visualiser les meubles de leur maison de manière plus réaliste.

Au-delà des applications grand public, SAM 3 s’avère précieux dans la recherche scientifique. Meta s’est associé à ConservationX et Osa Conservation pour analyser plus de 10 000 heures d’images de caméras animalières, identifiant plus de 100 espèces avec une plus grande précision. Cela démontre comment l’IA peut accélérer les efforts de conservation en automatisant l’analyse fastidieuse des données.

Stratégie IA de Meta : ambition et défis internes

Le développement de modèles SAM fait partie de l’effort plus large de Meta vers l’intelligence artificielle. L’entreprise a investi massivement dans le recrutement des meilleurs talents en IA plus tôt cette année, mais a également été confrontée à des revers internes. Des rapports récents indiquent une restructuration importante au sein de la division IA de Meta, incluant des licenciements et le départ potentiel d’un personnage clé, Yann LeCun. Malgré ces défis, Meta reste déterminé à devenir un leader de l’IA visuelle.

Ces progrès en matière d’intelligence visuelle vont probablement remodeler la façon dont nous interagissons avec le contenu numérique, rendant l’édition et l’analyse plus efficaces et intuitives. Même si les difficultés internes de Meta sont notables, le potentiel de SAM 3 et de modèles similaires pour stimuler l’innovation dans les domaines commercial et scientifique est indéniable.