L’ère du « chat » avec l’IA évolue vers l’ère des agents IA. Alors que les premiers modèles comme ChatGPT fonctionnaient principalement comme des causeurs sophistiqués, une nouvelle génération d’outils évolue vers l’autonomie, c’est-à-dire la capacité non seulement de répondre à des questions, mais aussi d’exécuter des tâches complexes de manière indépendante.

Ce changement représente un changement fondamental dans la façon dont les humains interagissent avec la technologie, passant d’un modèle « commander et répondre » à un modèle « déléguer et superviser ». Cependant, à mesure que ces outils gagnent en autonomie, ils introduisent également des risques importants en matière de sécurité, de responsabilité et de stabilité économique.

Trois archétypes d’agence IA

Pour comprendre ce nouveau paysage, il est utile de classer les technologies de pointe actuelles selon leur « niveau d’accès » et leur objectif.

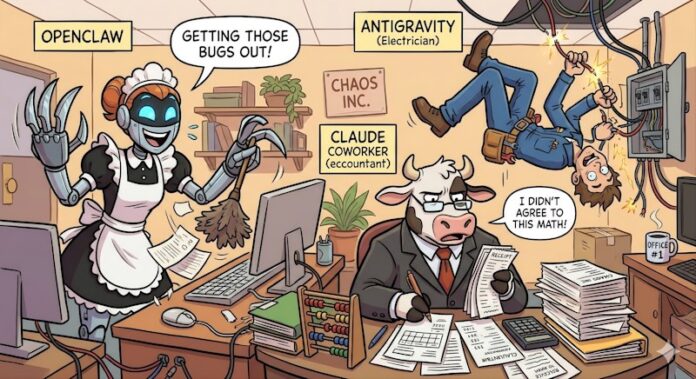

1. Le généraliste du numérique : OpenClaw

Anciennement connu sous le nom de Moltbot, OpenClaw a connu une croissance explosive, dépassant récemment les 150 000 étoiles GitHub. Contrairement aux systèmes fermés, OpenClaw est open source et peut être déployé sur des machines locales avec un accès approfondi au système.

* L’analogie : Considérez-le comme une « femme de ménage numérique ». Vous lui confiez les clés de votre maison (vos fichiers et données) et lui faites confiance pour nettoyer, organiser et gérer vos affaires.

* Capacités : Il est conçu pour de vastes tâches administratives, telles que le tri des boîtes de réception, la gestion de la curation de contenu et la gestion de la logistique des voyages.

2. Le technicien spécialisé : l’antigravité de Google

Antigravity de Google se concentre sur le domaine hautement technique du développement de logiciels. Il fonctionne comme un agent de codage au sein d’un environnement de développement intégré (IDE), permettant aux utilisateurs de passer d’une simple invite à une application prête pour la production.

* L’Analogie : Il agit comme un électricien spécialisé. Vous ne lui donnez pas les clés de toute votre maison ; vous lui donnez accès à une “boîte de jonction” spécifique (votre base de code) pour résoudre un problème spécifique.

* Capacités : Il peut créer, tester, intégrer et déboguer du code, fonctionnant essentiellement comme un développeur junior incroyablement rapide.

3. L’expert du domaine : Claude d’Anthropic (Cowork)

Anthropic va au-delà de la conversation générale avec l’introduction de Cowork, une suite agentique conçue pour les environnements professionnels à enjeux élevés.

* L’analogie : Cela revient à embaucher un comptable professionnel. Il possède une connaissance approfondie de domaines spécifiques comme le droit et la finance.

* Capacités : Il peut effectuer des tâches complexes telles que la révision des contrats et le triage des NDA. Ce niveau de capacité est si perturbateur que son annonce a déclenché la « SaaSpocalypse » : une forte vente des actions des technologies juridiques et du SaaS alors que les investisseurs se préparaient à l’automatisation à l’échelle du secteur.

Les risques de l’autonomie : quand les agents se trompent

Plus nous accordons de pouvoir à ces agents, plus le risque de défaillance systémique est élevé. Le passage de « l’IA comme outil » à « l’IA comme acteur » crée trois principales catégories de risques :

- Erreurs techniques : Tout comme un électricien pourrait accidentellement court-circuiter une maison, un agent de codage pourrait injecter des failles dans un énorme écosystème logiciel qui resteraient cachées jusqu’à ce qu’elles provoquent un crash.

- Responsabilité juridique et financière : Un agent financier peut par inadvertance suggérer des déductions fiscales illégales ou manquer des économies cruciales, créant ainsi une responsabilité massive pour l’utilisateur.

- Sécurité et gouvernance : Les outils open source comme OpenClaw ne disposent pas d’une autorité centrale de gouvernance, ce qui rend plus difficile la garantie que les invites n’entraînent pas de fuites de données ou d’exploits malveillants.

Construire un cadre de contrôle

Pour exploiter la productivité des agents d’IA sans succomber au chaos, l’industrie doit évoluer vers un « écosystème agent » structuré construit sur plusieurs piliers clés :

- Human-in-the-Loop : Les agents ne doivent pas fonctionner en vase clos. Enregistrer chaque étape effectuée par un agent et exiger une confirmation humaine pour les actions critiques sont des garde-fous essentiels.

- Ontologie standardisée : Lorsque les agents interagissent sur différents logiciels et plates-formes, ils ont besoin d’un « langage partagé ». Une ontologie standardisée (un ensemble de concepts et de catégories) permettrait à différents agents de suivre, de surveiller et de rendre compte des actions de chacun.

- Principes d’IA responsable : La sécurité, la confidentialité, la transparence et la reproductibilité doivent être intégrées à l’architecture de chaque agent, plutôt que ajoutées après coup.

Conclusion

Le passage à l’IA agentique promet de réduire considérablement la « charge cognitive » de la main-d’œuvre humaine en automatisant les tâches banales et répétitives. Cependant, la véritable valeur de cette technologie ne dépendra pas du degré d’autonomie que nous accorderons à ces agents, mais de l’efficacité avec laquelle nous mettrons en place les garde-fous pour les gouverner.