L’évolution de l’intelligence artificielle a atteint un point d’inflexion critique. Nous avons dépassé l’ère des simples interactions « questions-réponses », du type popularisé par les premières itérations de ChatGPT, et entrons dans l’ère de l’IA agentique. Contrairement aux chatbots standards, ces nouveaux agents autonomes ne se contentent pas de parler ; ils agissent.

Ce changement représente un changement fondamental dans la façon dont les humains interagissent avec la technologie, passant d’outils passifs à des collaborateurs actifs. Cependant, cette transition apporte à la fois un immense potentiel de productivité et des risques systémiques importants.

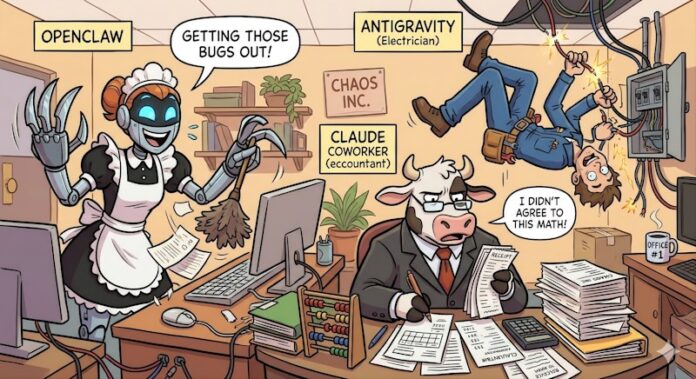

Une nouvelle classe de travailleurs du numérique

Pour comprendre ce nouveau paysage, il est utile de classer les outils émergents selon leur fonction et le niveau d’autonomie qui leur est accordé. Les leaders actuels du marché peuvent être perçus sous trois angles distincts :

1. La “Maid” Généraliste : OpenClaw

Anciennement connu sous les noms de Moltbot et Clawdbot, OpenClaw a connu une croissance explosive, rassemblant plus de 150 000 étoiles GitHub en quelques jours. Il fonctionne comme un généraliste à haut accès. Tout comme un travailleur domestique qui reçoit les clés d’une maison, OpenClaw est conçu pour gérer les fichiers, trier les boîtes de réception, organiser le contenu et planifier les voyages. Parce qu’il est open source, il offre un accès approfondi au système, lui permettant d’effectuer diverses tâches dans l’environnement numérique d’un utilisateur.

2. L’« Électricien » spécialisé : l’antigravité de Google

L’Antigravity de Google représente le professionnel spécialisé. Cet agent de codage fonctionne dans un environnement de développement intégré (IDE), accélérant la transition d’une simple invite à un produit fini. Il fonctionne comme un électricien qualifié : il maîtrise parfaitement un domaine spécifique (codage, test et intégration de logiciels) et n’a accès qu’à la « boîte de jonction » de la base de code qu’il doit réparer ou construire.

3. L’expert du domaine “Comptable” : Claude d’Anthropic (Cowork)

Anthropic a fait passer Claude d’un chatbot généraliste à un professionnel spécialisé via Cowork. En se concentrant sur les connaissances spécifiques à l’industrie, telles que la révision des contrats juridiques et le triage des NDA, Claude agit désormais comme un comptable. Elle possède une expertise approfondie dans des secteurs tels que le droit et la finance, et gère des données sensibles pour accomplir des tâches complexes et à enjeux élevés. Cette capacité est si perturbatrice qu’elle a déjà déclenché une volatilité du marché, souvent appelée la « SaaSpocalypse », affectant les valeurs des technologies juridiques et du SaaS.

Les risques de l’autonomie : des erreurs au « chaos »

Plus nous accordons de pouvoir à ces agents, plus les enjeux deviennent importants. Le passage de « outil » à « agent » introduit trois principales catégories de risques :

- Défaillance systémique : Tout comme un électricien non formé pourrait court-circuiter une maison, un agent IA pourrait injecter un code défectueux ou briser par inadvertance des systèmes interconnectés.

- Responsabilité juridique et financière : Un agent spécialisé comme Claude pourrait fournir des conseils fiscaux incorrects, passer à côté d’économies cruciales ou, pire encore, suggérer des radiations illégales entraînant des conséquences réglementaires.

- ** Lacunes en matière de gouvernance :** alors que les fournisseurs centralisés comme Google et Anthropic peuvent mettre en œuvre des protocoles de sécurité, les ** modèles open source comme OpenClaw ** ne disposent pas d’une autorité centrale pour appliquer les garde-fous, ce qui les rend plus difficiles à réglementer et plus sujets à une utilisation abusive.

Construire un cadre de confiance

Pour exploiter les avantages de l’IA agentique sans succomber au chaos, l’industrie doit évoluer vers un écosystème structuré basé sur les principes de l’IA responsable. Cela nécessite plus qu’un simple meilleur code ; cela nécessite un nouvel ensemble de normes opérationnelles :

- Humain dans la boucle : Les actions critiques doivent nécessiter une confirmation humaine, et chaque étape franchie par un agent doit être méticuleusement enregistrée pour en rendre compte.

- Ontologie standardisée : Lorsque les agents interagissent sur divers systèmes, ils ont besoin d’un « langage partagé ». La mise en œuvre d’une ontologie spécifique à un domaine garantit que les actions sont suivies, surveillées et comprises à la fois par les humains et les autres machines.

- Identité et sécurité distribuées : L’établissement de cadres d’identité et de confiance permettra aux agents d’opérer en toute sécurité au sein d’infrastructures numériques complexes.

L’objectif : Si elle est mise en œuvre avec une transparence et une sécurité rigoureuses, l’IA agentique ne remplacera pas les humains, mais soulagera plutôt la « charge cognitive » des tâches banales, permettant ainsi au personnel de se concentrer sur des efforts créatifs et stratégiques à haute valeur ajoutée.

Conclusion : La transition vers l’IA agentique offre un bond considérable en termes de productivité, mais son succès dépend de notre capacité à mettre en œuvre des garde-fous stricts, une communication standardisée et une surveillance humaine pour gérer les risques inhérents à l’autonomie.