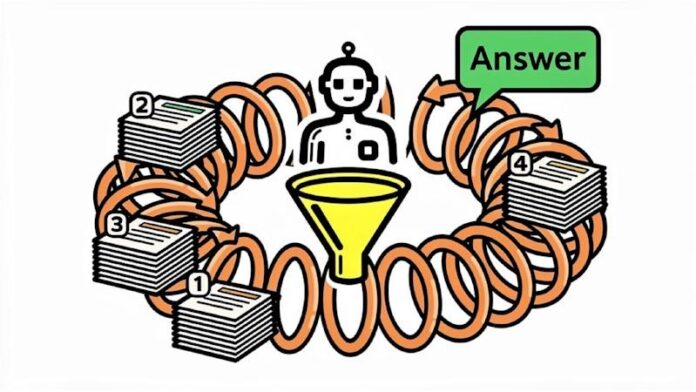

Databricks a dévoilé KARL (Knowledge Agents via Reinforcement Learning), un nouvel agent d’IA conçu pour surmonter les limites des pipelines traditionnels de génération augmentée de récupération (RAG). La plupart des systèmes RAG d’entreprise excellent dans un type de recherche, échouant silencieusement lorsqu’ils sont confrontés à d’autres. Un modèle optimisé pour la synthèse de rapports aura du mal à récupérer précisément les entités, tandis qu’un modèle axé sur la recherche échouera avec un raisonnement en plusieurs étapes. KARL vise à résoudre ce problème en étant formé pour gérer simultanément six comportements de recherche d’entreprise distincts.

Le problème avec les systèmes RAG actuels

Les systèmes RAG existants sont fragiles. Ils sont généralement optimisés pour des tâches de recherche spécifiques, ce qui les rend vulnérables face à la complexité du monde réel. Un agent formé pour répondre à des questions simples peut s’effondrer lorsqu’il est chargé de reconstruire des enregistrements internes fragmentés ou de synthétiser des informations à partir de notes de réunion non structurées. Ce manque de flexibilité oblige les équipes à créer des pipelines distincts pour chaque cas d’utilisation, ce qui crée des frais de maintenance et un accès aux connaissances cloisonné.

Comment fonctionne KARL : apprentissage par renforcement multitâche

Databricks a formé KARL à l’aide d’un nouvel algorithme d’apprentissage par renforcement (RL), atteignant des performances comparables à celles de Claude Opus 4.6 avec un coût par requête inférieur de 33 % et une latence inférieure de 47 %. Surtout, le modèle a été entièrement formé sur des données synthétiques générées par lui-même, éliminant ainsi le besoin d’un étiquetage humain coûteux. Cela a été possible grâce à OAPL, une politique d’optimisation de politique basée sur l’avantage optimal avec inférence décalée, que Databricks a co-développée avec des chercheurs de Cornell et de Harvard.

L’innovation clé d’OAPL est sa stabilité dans les environnements de formation distribués. Contrairement aux approches LLM RL traditionnelles, il gère efficacement les décalages politiques, permettant une formation efficace sur les échantillons et réduisant les coûts GPU. Cela rend le modèle viable pour un déploiement réaliste en entreprise.

Six comportements de recherche d’entreprise gérés par KARL

Pour évaluer KARL, Databricks a créé KARLBench, une référence évaluant les performances de six comportements de recherche critiques en entreprise :

- Recherche d’entités basée sur des contraintes : Récupération d’entités spécifiques dans des conditions strictes.

- Synthèse de rapports multi-documents : Combiner des informations provenant de plusieurs sources dans un rapport cohérent.

- Parcours de documents longs avec raisonnement tabulaire : Extraction d’informations à partir de documents volumineux avec des données numériques.

- Récupération exhaustive d’entités : Identifier toutes les entités pertinentes au sein d’un ensemble de données donné.

- Raisonnement procédural sur la documentation technique : Suivre les instructions étape par étape de manuels complexes.

- Agrégation de faits sur les notes internes de l’entreprise : Combiner des données fragmentées pour répondre à des questions complexes.

KARL a fait preuve d’une forte généralisation, exécutant bien les tâches pour lesquelles il n’a jamais été explicitement formé, contrairement aux systèmes RAG standard.

La couche de compression : gestion du contexte

Un défi majeur dans la recherche d’entreprise est la gestion de la fenêtre contextuelle des grands modèles linguistiques (LLM). Les systèmes RAG traditionnels s’appuient sur d’énormes bases de données vectorielles ou obligent les LLM à traiter trop d’informations à la fois. KARL résout ce problème en apprenant à compresser son propre contexte de bout en bout via RL. Lorsque le contexte dépasse les limites du LLM, l’agent le compresse, conservant la précision tout en restant dans les limites. Sans cette compression, les performances du modèle chutent considérablement.

Limites et feuille de route future

KARL est confronté à des requêtes présentant une ambiguïté inhérente, pour lesquelles plusieurs réponses valides existent. Le modèle abandonne parfois prématurément les requêtes complexes, ce qui, selon Databricks, est souvent le comportement correct en termes de rentabilité. Actuellement, KARL ne prend en charge que la recherche vectorielle ; l’intégration avec les bases de données SQL, les systèmes de fichiers et les calculs basés sur Python est prévue pour un développement futur.

Implications pour les équipes de données d’entreprise

KARL met en évidence trois considérations cruciales pour les équipes qui construisent leur infrastructure de récupération :

- L’architecture du pipeline est importante : Les pipelines RAG étroitement optimisés échoueront sur divers types de requêtes.

- L’apprentissage par renforcement est essentiel : La distillation à partir de modèles experts ne peut pas égaler les capacités de généralisation des agents formés par RL.

- L’efficacité est plus que le coût : Les agents de recherche spécialement conçus accomplissent les tâches plus rapidement, réduisent les requêtes inutiles et compressent efficacement le contexte.

Construire un modèle qui sait comment rechercher est plus précieux que de simplement tout acheminer via des API à usage général.