La era del “chatear” con IA está evolucionando hacia la era de los agentes de IA. Si bien los primeros modelos como ChatGPT funcionaban principalmente como conversadores sofisticados, una nueva generación de herramientas avanza hacia la autonomía: la capacidad no sólo de responder preguntas, sino también de ejecutar tareas complejas de forma independiente.

Este cambio representa un cambio fundamental en la forma en que los humanos interactúan con la tecnología, pasando de un modelo de “comando y respuesta” a un modelo de “delegar y supervisar”. Sin embargo, a medida que estas herramientas ganan más agencia, también introducen riesgos significativos en materia de seguridad, rendición de cuentas y estabilidad económica.

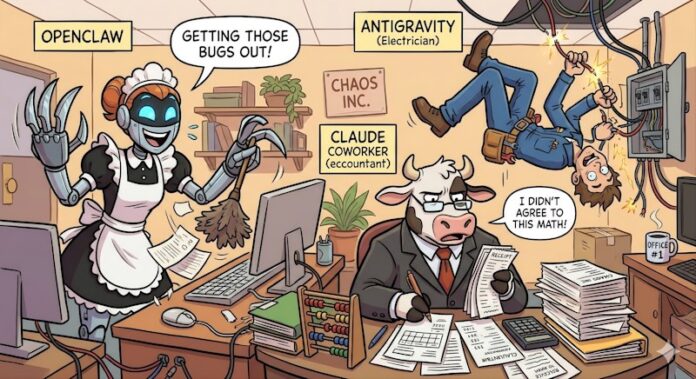

Tres arquetipos de agencia de IA

Para comprender este nuevo panorama, resulta útil categorizar las tecnologías líderes actuales por su “nivel de acceso” y su propósito previsto.

1. El generalista digital: OpenClaw

Anteriormente conocido como Moltbot, OpenClaw ha experimentado un crecimiento explosivo, superando recientemente las 150.000 estrellas de GitHub. A diferencia de los sistemas cerrados, OpenClaw es de código abierto y se puede implementar en máquinas locales con acceso profundo al sistema.

* La analogía: Piense en ello como una “criada digital”. Le das las llaves de tu hogar (tus archivos y datos) y confías en él para limpiar, organizar y administrar tus pertenencias.

* Capacidades: Está diseñado para tareas administrativas amplias, como clasificación de bandejas de entrada, gestión de curación de contenido y manejo de logística de viajes.

2. El técnico especializado: la antigravedad de Google

Antigravity de Google se centra en el dominio altamente técnico del desarrollo de software. Funciona como un agente de codificación dentro de un entorno de desarrollo integrado (IDE), lo que permite a los usuarios pasar de un único mensaje a una aplicación lista para producción.

* La Analogía: Actúa como un electricista especializado. No le das las llaves de toda tu casa; le das acceso a una “caja de conexiones” específica (tu código base) para solucionar un problema específico.

* Capacidades: Puede crear, probar, integrar y depurar código, funcionando esencialmente como un desarrollador junior increíblemente rápido.

3. El experto en dominios: Claude de Anthropic (Cowork)

Anthropic ha ido más allá de la conversación general con la introducción de Cowork, una suite de agencia diseñada para entornos profesionales de alto riesgo.

* La analogía: Es similar a contratar a un contador profesional. Posee un profundo conocimiento de dominio en sectores específicos como el derecho y las finanzas.

* Capacidades: Puede realizar tareas complejas como revisiones de contratos y clasificación de NDA. Este nivel de capacidad es tan disruptivo que su anuncio desencadenó el “SaaSpocalypse”: una fuerte liquidación de acciones de tecnología legal y SaaS mientras los inversores se preparaban para la automatización en toda la industria.

Los riesgos de la autonomía: cuando los agentes se equivocan

Cuanto más poder concedamos a estos agentes, mayor será el potencial de fallo sistémico. La transición de la “IA como herramienta” a la “IA como actor” crea tres categorías principales de riesgo:

- Errores técnicos: Así como un electricista podría provocar un cortocircuito accidental en una casa, un agente de codificación podría inyectar fallas en un ecosistema de software masivo que permanecen ocultos hasta que causan un bloqueo.

- Responsabilidad legal y financiera: Un agente financiero podría sugerir inadvertidamente cancelaciones de impuestos ilegales o perder ahorros críticos, creando una enorme responsabilidad para el usuario.

- Seguridad y gobernanza: las herramientas de código abierto como OpenClaw carecen de una autoridad de gobierno central, lo que dificulta garantizar que las indicaciones no conduzcan a fugas de datos o vulnerabilidades maliciosas.

Construyendo un marco para el control

Para aprovechar la productividad de los agentes de IA sin sucumbir al caos, la industria debe avanzar hacia un “ecosistema de agentes” estructurado construido sobre varios pilares clave:

- Human-in-the-Loop: Los agentes no deben operar en el vacío. Registrar cada paso que da un agente y solicitar confirmación humana para acciones críticas son barreras de seguridad esenciales.

- Ontología estandarizada: A medida que los agentes interactúan entre diferentes software y plataformas, necesitan un “lenguaje compartido”. Una ontología estandarizada (un conjunto de conceptos y categorías) permitiría a diferentes agentes rastrear, monitorear y dar cuenta de las acciones de cada uno.

- Principios de IA responsable: La seguridad, la privacidad, la transparencia y la reproducibilidad deben integrarse en la arquitectura de cada agente, en lugar de agregarse como una ocurrencia tardía.

Conclusión

El cambio hacia la IA agente promete reducir significativamente la “carga cognitiva” de la fuerza laboral humana al automatizar tareas mundanas y repetitivas. Sin embargo, el verdadero valor de esta tecnología dependerá no de cuánta autonomía concedamos a estos agentes, sino de la eficacia con la que construyamos las barreras para gobernarlos.