La evolución de la Inteligencia Artificial ha llegado a un punto de inflexión crítico. Estamos dejando atrás la era de las interacciones simples de “preguntas y respuestas”, del tipo popularizado por las primeras iteraciones de ChatGPT, y entrando en la era de la IA genética. A diferencia de los chatbots estándar, estos nuevos agentes autónomos no se limitan a hablar; ellos actúan.

Este cambio representa un cambio fundamental en la forma en que los humanos interactúan con la tecnología, pasando de herramientas pasivas a colaboradores activos. Sin embargo, esta transición trae consigo un inmenso potencial de productividad y riesgos sistémicos significativos.

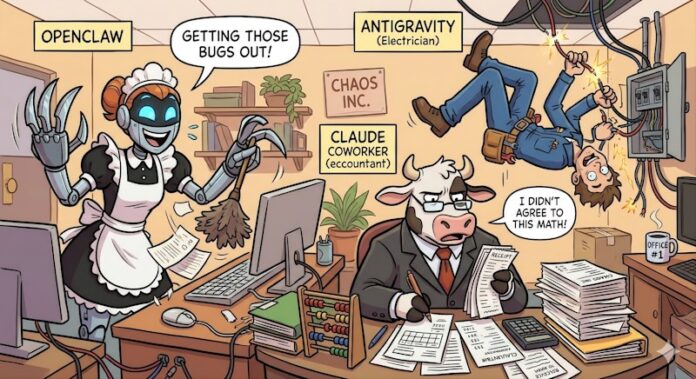

Una nueva clase de trabajadores digitales

Para comprender este nuevo panorama, resulta útil categorizar las herramientas emergentes por su función y el nivel de autonomía que se les otorga. Los líderes actuales del mercado pueden verse a través de tres lentes distintos:

1. La “criada” generalista: OpenClaw

Anteriormente conocido como Moltbot y Clawdbot, OpenClaw ha experimentado un crecimiento explosivo, acumulando más de 150.000 estrellas de GitHub en cuestión de días. Funciona como un generalista de alto acceso. Al igual que a un trabajador doméstico a quien se le dan las llaves de una casa, OpenClaw está diseñado para administrar archivos, clasificar bandejas de entrada, seleccionar contenido y planificar viajes. Debido a que es de código abierto, ofrece acceso profundo al sistema, lo que le permite realizar diversas tareas en el entorno digital de un usuario.

2. El “electricista” especializado: la antigravedad de Google

Antigravity de Google representa al profesional especializado. Este agente de codificación opera dentro de un entorno de desarrollo integrado (IDE), acelerando la transición de un mensaje simple a un producto terminado. Funciona como un electricista experto: es muy competente en un dominio específico (codificación, prueba e integración de software) y sólo se le concede acceso a la “caja de conexiones” del código base que necesita arreglar o construir.

3. El “Contador” experto en dominios: Claude de Anthropic (Cowork)

Anthropic ha convertido a Claude de un chatbot de uso general a un profesional especializado a través de Cowork. Al centrarse en conocimientos específicos de la industria, como revisiones de contratos legales y clasificación de NDA, Claude ahora actúa como un contador. Posee una profunda experiencia en sectores como el derecho y las finanzas, y maneja datos confidenciales para completar tareas complejas y de alto riesgo. Esta capacidad es tan disruptiva que ya ha desencadenado volatilidad en el mercado, a menudo denominada “SaaSpocalypse”, que afecta a las acciones de tecnología legal y SaaS.

Los riesgos de la autonomía: del error al “caos”

Cuanto más poder otorgamos a estos agentes, mayores son los riesgos. La transición de “herramienta” a “agente” introduce tres categorías principales de riesgo:

- Falla sistémica: Así como un electricista no capacitado podría provocar un cortocircuito en una casa, un agente de IA podría inyectar un código defectuoso o romper sin darse cuenta los sistemas interconectados.

- Responsabilidad legal y financiera: Un agente especializado como Claude podría brindar asesoramiento fiscal incorrecto, omitir ahorros cruciales o, peor aún, sugerir cancelaciones ilegales que conduzcan a consecuencias regulatorias.

- Deficiencias de gobernanza: Si bien los proveedores centralizados como Google y Anthropic pueden implementar protocolos de seguridad, los modelos de código abierto como OpenClaw carecen de una autoridad central para hacer cumplir las barreras de seguridad, lo que las hace más difíciles de regular y más propensas a su uso indebido.

Construyendo un marco para la confianza

Para aprovechar los beneficios de la IA agente sin sucumbir al caos, la industria debe avanzar hacia un ecosistema estructurado basado en los principios de la IA responsable. Esto requiere algo más que un mejor código; requiere un nuevo conjunto de estándares operativos:

- Human-in-the-Loop: Las acciones críticas deben requerir confirmación humana, y cada paso que da un agente debe registrarse meticulosamente para su rendición de cuentas.

- Ontología estandarizada: A medida que los agentes interactúan en diversos sistemas, necesitan un “lenguaje compartido”. La implementación de una ontología específica de dominio garantiza que las acciones sean rastreadas, monitoreadas y comprendidas tanto por humanos como por otras máquinas.

- Identidad y seguridad distribuidas: El establecimiento de marcos para la identidad y la confianza permitirá a los agentes operar de forma segura dentro de infraestructuras digitales complejas.

El objetivo: Si se implementa con rigurosas transparencia y seguridad, la IA agente no reemplazará a los humanos, sino que descargará la “carga cognitiva” de las tareas mundanas, permitiendo que la fuerza laboral se concentre en esfuerzos creativos, estratégicos y de alto valor.

Conclusión: La transición a la IA agencial ofrece un enorme salto en productividad, pero su éxito depende de nuestra capacidad para implementar barreras de seguridad estrictas, comunicación estandarizada y supervisión humana para gestionar los riesgos inherentes a la autonomía.