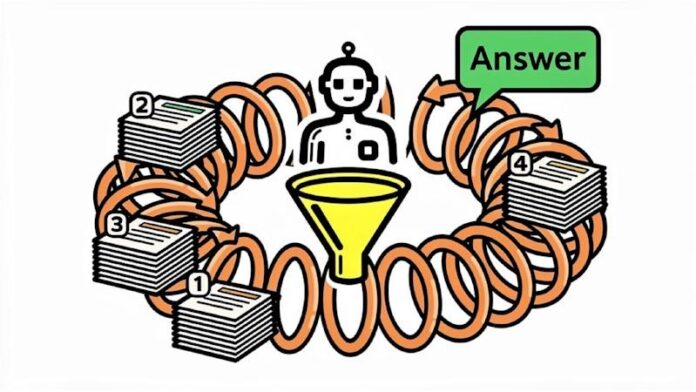

Databricks ha presentado KARL (Agentes de conocimiento a través del aprendizaje por refuerzo), un nuevo agente de inteligencia artificial diseñado para superar las limitaciones de las canalizaciones tradicionales de recuperación-generación aumentada (RAG). La mayoría de los sistemas RAG empresariales destacan en un tipo de búsqueda y fallan silenciosamente cuando se enfrentan a otros. Un modelo optimizado para la síntesis de informes tendrá dificultades para recuperar entidades con precisión, mientras que un modelo centrado en la búsqueda fallará en el razonamiento de varios pasos. KARL pretende resolver esto capacitándolo para manejar seis comportamientos de búsqueda empresarial distintos simultáneamente.

El problema con los sistemas RAG actuales

Los sistemas RAG existentes son frágiles. Por lo general, están ajustados para tareas de búsqueda específicas, lo que los deja vulnerables ante la complejidad del mundo real. Un agente capacitado para responder preguntas simples puede colapsar cuando se le asigna la tarea de reconstruir registros internos fragmentados o sintetizar inteligencia a partir de notas de reuniones no estructuradas. Esta inflexibilidad obliga a los equipos a crear canales separados para cada caso de uso, lo que genera gastos de mantenimiento y acceso al conocimiento aislado.

Cómo funciona KARL: aprendizaje por refuerzo multitarea

Databricks entrenó a KARL utilizando un novedoso algoritmo de aprendizaje por refuerzo (RL), logrando un rendimiento comparable al de Claude Opus 4.6 con un costo por consulta un 33 % menor y una latencia un 47 % menor. Fundamentalmente, el modelo se entrenó enteramente con datos sintéticos generados por él mismo, eliminando la necesidad de un costoso etiquetado humano. Esto fue posible gracias a OAPL, una política de optimización de políticas basada en ventajas óptimas con inferencia retrasada, que Databricks desarrolló conjuntamente con investigadores de Cornell y Harvard.

La innovación clave de OAPL es su estabilidad en entornos de formación distribuidos. A diferencia de los enfoques tradicionales de LLM RL, maneja los retrasos de políticas de manera efectiva, lo que permite una capacitación eficiente en muestras y reduce los costos de GPU. Esto hace que el modelo sea viable para una implementación empresarial realista.

Seis comportamientos de búsqueda empresarial gestionados por KARL

Para evaluar KARL, Databricks creó KARLBench, un punto de referencia que evalúa el rendimiento en seis comportamientos de búsqueda empresarial críticos:

- Búsqueda de entidades basada en restricciones: Recuperación de entidades específicas bajo condiciones estrictas.

- Síntesis de informes entre documentos: Combinación de información de múltiples fuentes en un informe coherente.

- Recorrido de documentos largos con razonamiento tabular: Extracción de información de documentos grandes con datos numéricos.

- Recuperación exhaustiva de entidades: Identificar todas las entidades relevantes dentro de un conjunto de datos determinado.

- Razonamiento procesal sobre documentación técnica: Siguiendo instrucciones paso a paso de manuales complejos.

- Agregación de hechos sobre notas internas de la empresa: Combinación de datos fragmentados para responder preguntas complejas.

KARL demostró una fuerte generalización y se desempeñó bien en tareas en las que nunca fue entrenado explícitamente, a diferencia de los sistemas RAG estándar.

The Compression Layer: Context Management

Un desafío importante en la búsqueda empresarial es la gestión de la ventana contextual de los modelos de lenguaje grandes (LLM). Los sistemas RAG tradicionales dependen de bases de datos vectoriales masivas o obligan a los LLM a procesar demasiada información a la vez. KARL aborda esto aprendiendo a comprimir su propio contexto de un extremo a otro a través de RL. Cuando el contexto excede los límites del LLM, el agente lo comprime, conservando la precisión mientras se mantiene dentro de los límites. Sin esta compresión, el rendimiento del modelo cae significativamente.

Limitaciones y hoja de ruta futura

KARL lucha con consultas con ambigüedad inherente, donde existen múltiples respuestas válidas. A veces, el modelo abandona prematuramente las consultas complejas, lo que, según Databricks, suele ser el comportamiento correcto para la rentabilidad. Actualmente, KARL sólo admite la búsqueda vectorial; Se planea desarrollar en el futuro la integración con bases de datos SQL, sistemas de archivos y cálculos basados en Python.

Implicaciones para los equipos de datos empresariales

KARL destaca tres consideraciones cruciales para los equipos que construyen su infraestructura de recuperación:

- La arquitectura de las canalizaciones importa: Las canalizaciones RAG estrechamente optimizadas fallarán en diversos tipos de consultas.

- El aprendizaje por refuerzo es clave: La destilación de modelos expertos no puede igualar las capacidades de generalización de los agentes capacitados en RL.

- La eficiencia es más que el costo: Los agentes de búsqueda especialmente diseñados completan las tareas más rápido, reducen las consultas desperdiciadas y comprimen el contexto de manera efectiva.

Crear un modelo que sepa cómo buscar es más valioso que simplemente enrutar todo a través de API de propósito general.