Meta hat die dritte Generation seiner „Segment Anything Models“ (SAM) vorgestellt, einer Suite von KI-Tools für erweiterte visuelle Analysen. Diese neuen Systeme unterscheiden sich zwar von Metas beliebten großen Llama-Sprachmodellen, stellen aber einen bedeutenden Fortschritt in der Art und Weise dar, wie Maschinen die physische Welt „sehen“ und mit ihr interagieren. SAM 3 konzentriert sich auf die präzise Objekterkennung und -segmentierung, was bedeutet, dass Elemente in Bildern und Videos genau identifiziert und isoliert werden können.

So funktioniert SAM 3: Präzises visuelles Verständnis

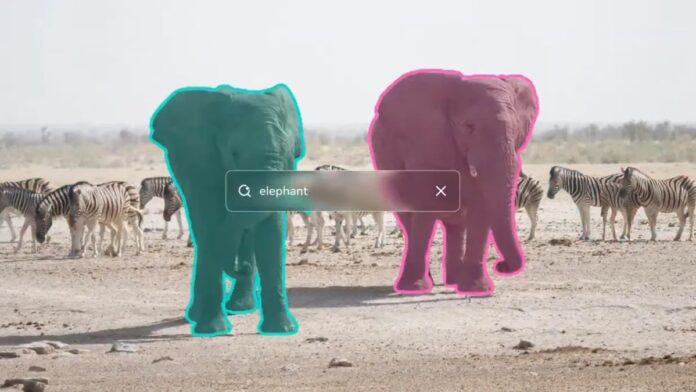

Im Gegensatz zu KI-Chatbots zeichnen sich SAM-Modelle dadurch aus, dass sie bestimmte Objekte selbst in komplexen Szenen erkennen. Meta trainierte SAM 3 anhand riesiger Datensätze aus Bildern und Videos gepaart mit detaillierten Textbeschreibungen. Dadurch kann die KI auf ganz spezifische Anfragen reagieren: zum Beispiel alle Elefanten auf einem Foto auswählen oder „rote Hüte“ in einer Menschenmenge hervorheben. Die Fähigkeit des Modells, differenzierte Abfragen zu interpretieren, ist seine größte Stärke.

Diese Modelle dienen nicht der Erstellung neuer Bilder oder Videos, sondern der Analyse bestehender visueller Inhalte. Entwickler können über Metas Segment Anything Playground auf Open-Weights-Versionen zugreifen. Die tatsächlichen Auswirkungen werden jedoch alltägliche Benutzer durch Verbesserungen auf Metas eigenen Plattformen spüren.

Praktische Anwendungen: Von sozialen Medien bis zum Naturschutz

Meta integriert SAM 3 in mehrere seiner Produkte:

- Instagram-Bearbeitungen und Vibes: Ermöglicht eine präzisere Stapelbearbeitung von Bildern und Videos.

- Facebook-Marktplatz: Verbesserung der Funktion „Ansicht in einem Raum“, damit Benutzer Möbel in ihren Häusern realistischer visualisieren können.

Über Verbraucheranwendungen hinaus erweist sich SAM 3 in der wissenschaftlichen Forschung als wertvoll. Meta hat mit ConservationX und Osa Conservation zusammengearbeitet, um über 10.000 Stunden Wildkameraaufnahmen zu analysieren und so über 100 Arten mit größerer Genauigkeit zu identifizieren. Dies zeigt, wie KI Naturschutzbemühungen durch die Automatisierung aufwändiger Datenanalysen beschleunigen kann.

Metas KI-Strategie: Ehrgeiz und interne Herausforderungen

Die Entwicklung von SAM-Modellen ist Teil von Metas umfassenderem Vorstoß in die künstliche Intelligenz. Das Unternehmen investierte Anfang des Jahres stark in die Abwerbung von Top-KI-Talenten, musste aber auch interne Rückschläge hinnehmen. Jüngste Berichte deuten auf erhebliche Umstrukturierungen innerhalb der KI-Abteilung von Meta hin, einschließlich Entlassungen und dem möglichen Abgang einer Schlüsselfigur, Yann LeCun. Trotz dieser Herausforderungen ist Meta weiterhin bestrebt, führend im Bereich der visuellen KI zu werden.

Diese Fortschritte in der visuellen Intelligenz werden wahrscheinlich die Art und Weise, wie wir mit digitalen Inhalten interagieren, verändern und die Bearbeitung und Analyse effizienter und intuitiver gestalten. Während Metas interne Probleme bemerkenswert sind, ist das Potenzial von SAM 3 und ähnlichen Modellen, Innovationen sowohl im kommerziellen als auch im wissenschaftlichen Bereich voranzutreiben, unbestreitbar.